第27章: 删失和选择

27 删失和选择

27.1 介绍

当因变量受到约束时,就会发生删失回归,导致边界上的观测值堆积。当采样是内生的时,就会发生选择。在审查或选择下,传统的(例如最小二乘法)估计量对于未经审查/未选择的分布的总体参数存在偏差。已经开发出一些方法来规避这种偏差,包括 Tobit、CLAD 和样本选择估计器。

欲了解更多详细信息,请参阅 Maddala (1983)、Amemiya (1985)、Gourieroux (2000)、Cameron 和 Trivedi (2005) 以及 Wooldridge (2010)。

27.2 审查

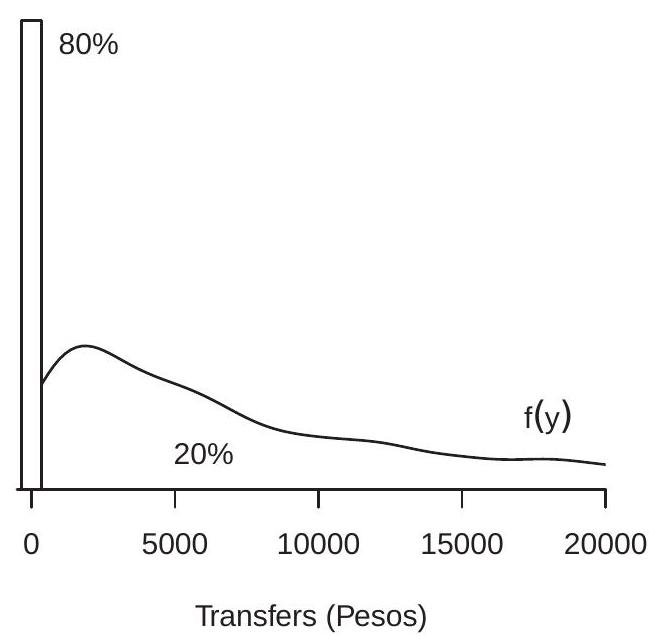

在经济应用中,因变量具有混合离散/连续分布是很常见的,其中离散分量位于支持边界上。最常见的情况是,该边界出现在 0 处。例如,图 27.1(a) 显示了数据文件 \(\mathrm{CH} \mathrm{J} 2004\) 中 tabroad(来自国外的传输)的密度。该变量是菲律宾家庭从国外收到的汇款金额 \({ }^{1}\)。对于 \(80 %\) 家庭,此变量等于 0 。关联的质点由零处的条形显示。对于\(20 %\) 的家庭来说,tabroad 是正的,并且连续分布,具有粗右尾。相关的密度通过折线图显示。

鉴于这些观察结果,尚不清楚如何进行回归分析。我们应该使用包含 0 的完整样本吗?我们应该只使用不包括 0 的子样本吗?或者我们应该做点别的什么?

为了回答这些问题,有一个统计模型很有用。经典框架是审查回归,它假设观察到的变量是潜在连续分布变量的审查版本。不失一般性,我们重点关注从下到零进行审查的情况。

审查回归模型由 Tobin (1958) 提出,用于解释家庭耐用品消费。托宾观察到,在调查数据中,相当一部分家庭的耐用品消费为零。他建议将观察结果视为来自连续的审查的实现。

\({ }^{1}\) 以千菲律宾比索为单位。

- 从国外转账

.jpg)

- 审查程序

图 27.1:截尾密度

分配。他的模型是

\[ \begin{aligned} &Y^{*}=X^{\prime} \beta+e \\ &e \mid X \sim \mathrm{N}\left(0, \sigma^{2}\right) \\ &Y=\max \left(Y^{*}, 0\right) . \end{aligned} \]

该模型称为 Tobit 回归或删失回归。它也称为 Type 1 Tobit 模型。变量 \(Y^{*}\) 是潜在的(未观察到)。观察到的变量 \(Y\) 从下方审查为零。这意味着正值未经审查,负值转换为 0 。该审查模型复制了在 0 处观测到的堆积现象。

Tobit 模型可以通过潜在选择框架来证明,其中个体的最优(无约束)连续分布选择是 \(Y^{*}\)。然而,可行的选择仅限于满足 \(Y \geq 0\)。 (例如,不允许负购买。)因此,实现值 \(Y\) 是 \(Y^{*}\) 的审查版本。为了证明模型的这种解释是合理的,我们需要设想一个背景,其中所需的选择包括负值。对于消费购买来说,这可能是一种紧张的解释,但当负值具有经济意义时,这可能是合理的。

审查过程如图 27.1(b) 所示。潜在变量 \(Y^{*}\) 的正态密度以 \(X^{\prime} \beta\) 为中心。 \(Y^{*}>0\) 的部分保持不变,而 \(Y^{*}<0\) 的部分则转换为零处的点质量。密度的位置和审查程度由条件平均值 \(X^{\prime} \beta\) 控制。随着 \(X^{\prime} \beta\) 向右移动,审查量减少。当 \(X^{\prime} \beta\) 向左移动时,审查量会增加。

审查问题的常见“补救措施”是删除审查的观察结果。这将创建一个截断分布,该分布由以下转换定义

\[ Y^{\#}=\left\{\begin{array}{cc} Y & \text { if } Y>0 \\ \text { missing } & \text { if } Y=0 . \end{array}\right. \]

在图27.1(a)和图27.1(b)中,截断分布是0以上的连续部分,省略了0处的质点。

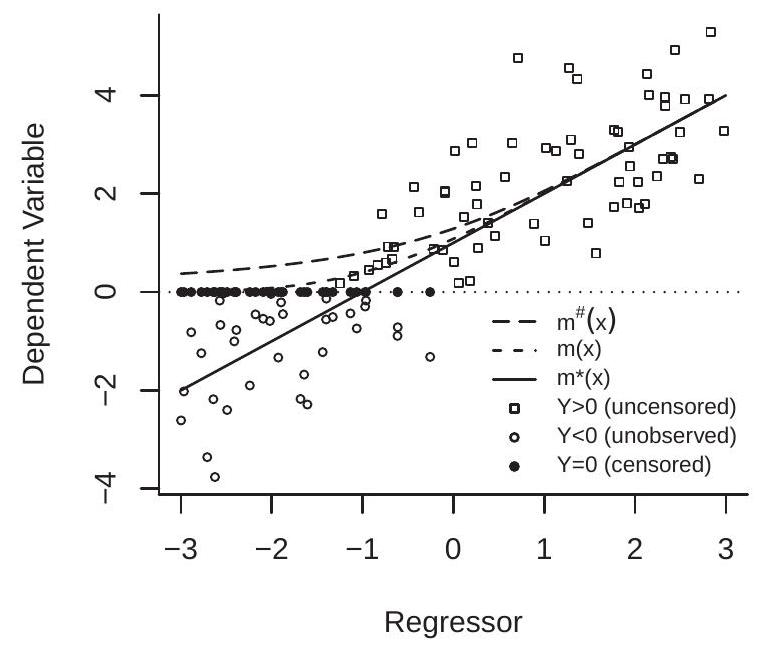

审查和截断过程如图 27.2(a) 所示,其中绘制了 100 个随机 \(^{2}\) 和 \(\left(Y^{*}, X\right)\)。未经审查的变量用空心圆圈和正方形标记。空心方块是 \(Y^{*}>0\) 的实现,空心圆圈是 \(Y^{*}<0\) 的实现。删失分布将 \(Y^{*}\) 的负值替换为 0 ,从而将空心圆替换为实心圆。因此,截尾分布由空心正方形和实心圆圈组成。截断分布是通过删除删失观测值获得的,因此仅包含空心方块。

- 删失回归函数

.jpg)

- 审查概率

图 27.2:截尾分布的属性

总结一下:我们区分三种分布和变量:未经审查的 \(\left(Y^{*}\right)\)、审查的 \((Y)\) 和截断的 \(\left(Y^{\#}\right)\)。

删失回归模型(27.1)做出了几个强有力的假设:(1)条件均值的线性; (2) 误差的独立性; (3)正态分布。线性假设并不重要,因为我们可以将 \(X^{\prime} \beta\) 解释为级数展开或类似的灵活近似。然而,独立性假设非常重要,因为它的违反(例如异方差性)会改变审查过程的属性。正态性假设也相当重要,但很难从第一原理中证明其合理性。

27.3 删失回归函数

我们可以计算删失随机变量的条件分布的一些属性。审查的条件概率是

\[ \mathbb{P}\left[Y^{*}<0 \mid X\right]=\mathbb{P}\left[e<-X^{\prime} \beta \mid X\right]=\Phi\left(-\frac{X^{\prime} \beta}{\sigma}\right) . \]

\({ }^{2} X \sim U[-3,3]\) 和 \(Y^{*} \mid X \sim \mathrm{N}(1+X, 1)\) 我们在图 27.2(b) 中进行说明。对于图 \(27.2(\mathrm{a})\) 中的示例,这将审查概率绘制为 \(X\) 的函数。 \(X=-1\) 的审查概率为 \(98 %\),\(X=-3,50 %\) 的审查概率为 \(98 %\),\(X=1\) 的审查概率为 \(2 %\)。

未经审查、审查和截断分布的条件平均值为

\[ \begin{aligned} m^{*}(X) &=\mathbb{E}\left[Y^{*} \mid X\right]=X^{\prime} \beta, \\ m(X) &=\mathbb{E}[Y \mid X]=X^{\prime} \beta \Phi\left(\frac{X^{\prime} \beta}{\sigma}\right)+\sigma \phi\left(\frac{X^{\prime} \beta}{\sigma}\right) \\ m^{\#}(X) &=\mathbb{E}\left[Y^{\#} \mid X\right]=X^{\prime} \beta+\sigma \lambda\left(\frac{X^{\prime} \beta}{\sigma}\right) . \end{aligned} \]

(27.3) 中的函数 \(\lambda(x)=\phi(x) / \Phi(x)\) 称为逆米尔斯比率。要获得 (27.2) 和 (27.3),请参阅《经济学家概率论与数理统计》的定理 5.8.4 和 5.8.6 以及练习 27.1。

由于 \(Y^{*} \leq Y \leq Y^{\#}\) ,因此

\[ m^{*}(x) \leq m(x) \leq m^{\#}(x) \]

如果审查概率为正,则具有严格的不等式。这表明截断和审查分布的条件均值相对于未经审查的条件均值存在偏差。

我们在图 27.2(a) 中进行了说明。未经审查的平均值 \(m^{*}(x)\) 用直线标记,审查的平均值 \(m(x)\) 用虚线标记,截断的平均值 \(m^{\#}(x)\) 用长破折号标记。这些函数严格按照显示最高偏差的截断均值进行排序。

27.4 最小二乘估计的偏差

如果观测值 \((Y, X)\) 是由删失模型 (27.1) 生成的,则使用包含删失观测值的完整样本或不包括删失观测值的截断样本进行的最小二乘估计将会产生偏差。事实上,与 CEF 一致的估计器(例如级数估计器)将分别估计删失样本和截断样本中的删失平均值 \(m(x)\) 或截断平均值 \(m^{\#}(x)\),而不是潜在 CEF \(m^{*}(x)\)。

考虑 \(Y\) 在 \(X\) 上的最佳线性预测器的属性也很有趣,它是最小二乘估计器的估计量。一般来说,这取决于回归量的边际分布。然而,当回归量呈正态分布时,它采用 Greene (1981) 发现的简单形式。将具有显式截距的模型编写为 \(Y^{*}=\alpha+X^{\prime} \beta+e\) 并假设 \(X \sim \mathrm{N}(0, \Sigma)\)。格林表明最佳线性预测斜率系数是

\[ \beta_{\mathrm{BLP}}=\beta(1-\pi) \]

其中 \(\pi=\mathbb{P}[Y=0]\) 是审查概率。我们在本节末尾推导出(27.4)。

格林公式(27.4)表明最小二乘斜率系数随着审查百分比成比例地向零收缩。虽然格林公式对于正态回归量来说是特殊的,但它给出了由于审查而产生的偏差的基线估计。审查比例 \(\pi\) 很容易从样本中估计出来(例如我们的转移示例中的 \(\pi=0.80\)),从而可以快速计算由于审查而产生的预期偏差。这可以作为经验法则。如果预期偏差足够小(例如小于 5%),则所得的预期估计偏差(例如 5%)可能是可接受的,从而导致使用完整样本进行传统最小二乘估计,而无需明确的审查处理。然而,如果审查比例 \(\pi\) 足够高(例如 10%),则可能需要纠正审查偏差的估计方法。

我们通过推导(27.4)来结束本节。 Goldberger (1981) 建议的一个技巧简化了计算。请注意 \(Y^{*} \sim \mathrm{N}\left(\alpha, \sigma_{Y}^{2}\right)\) 和 \(\sigma_{Y}^{2}=\sigma^{2}+\beta^{\prime} \Sigma \beta\)。使用截断正态分布的矩(经济学家的概率与统计,定理 5.7.6 和 5.7.8)并设置 \(\lambda=\lambda\left(\alpha / \sigma_{Y}\right)\) 我们可以计算出

\[ \begin{aligned} \mathbb{E}\left[\left(Y^{*}-\alpha\right) Y^{*} \mid Y^{*}>0\right] &=\operatorname{var}\left[Y^{*} \mid Y^{*}>0\right]+\left(\mathbb{E}\left[Y^{*} \mid Y^{*}>0\right]-\alpha\right) \mathbb{E}\left[Y^{*} \mid Y^{*}>0\right] \\ &=\sigma_{Y}^{2}\left(1-\frac{\alpha}{\sigma_{Y}} \lambda-\lambda^{2}\right)+\sigma_{Y} \lambda\left(\alpha+\sigma_{Y} \lambda\right)=\sigma_{Y}^{2} . \end{aligned} \]

\(X\) 在 \(Y^{*}\) 上的投影是 \(X=\mathbb{E}\left[X Y^{*}\right] \sigma_{Y}^{-2}\left(Y^{*}-\alpha\right)+u\),其中 \(u\) 独立于 \(Y^{*}\)。这意味着

\[ \begin{aligned} \mathbb{E}\left[X Y^{*} \mid Y^{*}>0\right] &=\mathbb{E}\left[\left(\mathbb{E}\left[X Y^{*}\right] \sigma_{Y}^{-2}\left(Y^{*}-\alpha\right)+u\right) Y^{*} \mid Y^{*}>0\right] \\ &=\mathbb{E}\left[X Y^{*}\right] \sigma_{Y}^{-2} \mathbb{E}\left[\left(Y^{*}-\alpha\right) Y^{*} \mid Y^{*}>0\right] \\ &=\mathbb{E}\left[X Y^{*}\right] \end{aligned} \]

因此

\[ \begin{aligned} \beta_{\mathrm{BLP}} &=\mathbb{E}\left[X X^{\prime}\right]^{-1} \mathbb{E}[X Y] \\ &=\mathbb{E}\left[X X^{\prime}\right]^{-1} \mathbb{E}\left[X Y^{*} \mid Y^{*}>0\right](1-\pi) \\ &=\mathbb{E}\left[X X^{\prime}\right]^{-1} \mathbb{E}\left[X Y^{*}\right](1-\pi) \\ &=\beta(1-\pi) \end{aligned} \]

正如所声称的那样,这是(27.4)。

27.5 托比特估计器

Tobin (1958) 提出通过最大似然估计删失回归模型 (27.1)。

删失变量 \(Y\) 具有条件分布函数,该函数是连续分量和离散分量的混合:

\[ F(y \mid x)=\left\{\begin{array}{cc} 0, & y<0 \\ \Phi\left(\frac{y-x^{\prime} \beta}{\sigma}\right), & y \geq 0 \end{array}\right. \]

相关的密度 \({ }^{3}\) 函数是

\[ f(y \mid x)=\Phi\left(-\frac{x^{\prime} \beta}{\sigma}\right)^{\mathbb{1}\{y=0\}}\left[\sigma^{-1} \phi\left(\frac{y-x^{\prime} \beta}{\sigma}\right)\right]^{\mathbb{1}\{y>0\}} . \]

第一个分量是审查概率,第二个分量是正态回归密度。

对数似然是根据观测值评估的对数密度函数的总和:

\[ \begin{aligned} \ell_{n}\left(\beta, \sigma^{2}\right) &=\sum_{i=1}^{n} \log f\left(Y_{i} \mid X_{i}\right) \\ &=\sum_{i=1}^{n}\left(\mathbb{1}\left\{Y_{i}=0\right\} \log f\left(Y_{i} \mid X_{i}\right)+\mathbb{1}\left\{Y_{i}>0\right\} \log \left[\sigma^{-1} \phi\left(\frac{Y_{i}-X_{i}^{\prime} \beta}{\sigma}\right)\right]\right) \\ &=\sum_{Y_{i}=0} \log \Phi\left(-\frac{X_{i}^{\prime} \beta}{\sigma}\right)-\frac{1}{2} \sum_{Y_{i}>0}\left(\log \left(2 \pi \sigma^{2}\right)+\frac{1}{\sigma^{2}}\left(Y_{i}-X_{i}^{\prime} \beta\right)^{2}\right) \end{aligned} \]

\({ }^{3}\) 由于分布函数在 \(y=0\) 处不连续,因此密度在技术上是相对于混合连续/离散测量的导数。第一个组件与概率模型中的相同,第二个组件与正态回归模型中的相同。

\(\operatorname{MLE}\left(\widehat{\beta}, \widehat{\sigma}^{2}\right)\) 是最大化对数似然 \(\ell_{n}\left(\beta, \sigma^{2}\right)\) 的值。由于该估计量与概率估计量的联系,戈德伯格将其昵称为“Tobit”。 Amemiya (1973) 建立了其渐近正态性。

正如 Olsen (1978) 所示,如果我们将参数转换为 \(\gamma=\beta / \sigma\) 和 \(\nu=1 / \sigma\),计算会得到改进。那么重新参数化的对数似然等于

\[ \ell_{n}(\gamma, v)=\sum_{Y_{i}=0} \log \Phi\left(-X_{i}^{\prime} \gamma\right)+\sum_{Y_{i}>0} \log (v / \sqrt{2 \pi})+\left(-\frac{1}{2}\right) \sum_{Y_{i}>0}\left(Y_{i} v-X_{i}^{\prime} \gamma\right)^{2} . \]

这是三项之和,每一项在 \((\gamma, v)\) 中都是全局凹的(正如我们现在讨论的),因此 \(\ell_{n}(\gamma, v)\) 在 \((\gamma, v)\) 中是全局凹的,确保基于牛顿的优化器的全局收敛。事实上,(27.5) 中的第三项是 \((\gamma, \nu)\) 中二次方程的负数,因此是凹的。 (27.5) 中的第二项在 \(v\) 中是对数的,它是凹的。 (27.5) 中的第一项仅是 \(\gamma\) 的函数,并且具有二阶导数

\[ \frac{\partial^{2}}{\partial \gamma \partial \gamma^{\prime}} \sum_{Y_{i}=0} \log \Phi\left(-X_{i}^{\prime} \gamma\right)=\sum_{Y_{i}=0} X_{i} X_{i}^{\prime} \lambda^{\prime}\left(-X_{i}^{\prime} \gamma\right) \]

这是负定的,因为米尔斯比率满足 \(\lambda^{\prime}(u)<0\)(参见《经济学家概率与统计》中的定理 5.7.7)。因此(27.5)中的第一项是凹的。

在 Stata 中,可以使用 tobit 命令估计 Tobit 回归。在 R 中,有多个选项,包括 AER 包中的 tobit 命令。

詹姆斯·托宾 美国的詹姆斯·托宾(James Tobin,1918-2002)是宏观经济学的领军人物之一。 二十世纪中叶的经济学家和 1981 年诺贝尔奖得主

经济科学奖。他 1958 年的论文介绍了审查回归和

它的 MLE,通常称为 Tobit 估计器。作为一个令人着迷的巧合,

“托比特”这个名字也出现在 1951 年的小说《凯恩叛变》中,该小说以美国海军为背景 第二次世界大战期间的驱逐舰。作者在小说中曾描述过

一位名叫“托比特”的船员,拥有“像海绵一样的头脑”,因为他的…… 智力强。事实证明,作者(赫尔曼·沃克)和詹姆斯·托宾曾服务过\ 二战期间在同一艘海军驱逐舰上。去搞清楚!

27.6 Tobit 回归中的识别

Tobit 模型 (27.1) 做出了几个强有力的假设。哪些是关键的?为了研究这个问题,请考虑非参数审查回归框架

\[ \begin{aligned} Y^{*} &=m(X)+e \\ \mathbb{E}[e] &=0 \\ Y &=\max \left(Y^{*}, 0\right) \end{aligned} \]

其中\(e \sim F\)独立于\(X\),回归函数\(m(x)\)和分布函数\(F(e)\)未知。识别什么?

假设随机变量 \(m(X)\) 在实线上具有无界支持(当 \(m(X)=X^{\prime} \beta\) 和 \(X\) 具有无界分布(例如正态分布)时会发生这种情况)。然后我们可以找到一个集合 \(\mathscr{X} \subset \mathbb{R}^{k}\) 使得 \(x \in \mathscr{X}, \mathbb{P}[Y=0 \mid X=x]=F(-m(x)) \simeq 0\) 成立。然后我们可以想象获取 \(X \in \mathscr{X}\) 的观测值的子样本。函数 \(m(x)\) 被识别为 \(x \in \mathscr{X}\),从而允许识别分布 \(F(e)\)。由于审查概率 \(m(X)\) 是全局确定的,因此函数 \(m(X)\) 也是全局确定的。这个讨论表明,只要我们保持 \(m(X)\) 和 \(m(X)\) 独立的假设,当 CEF \(m(X)\) 完全支持时,回归函数 \(m(X)\) 和分布函数 \(m(X)\) 是非参数确定的。然而,正如我们现在所讨论的,这两个假设是必不可少的。

假设完全支持条件失败,因为回归函数的边界为 \(m(X) \leq\) \(\bar{m}\) 的值使得 \(\mathbb{P}[Y=0 \mid X=x]=F(-\bar{m})>0\)。在这种情况下,无法识别 \(e \leq-\bar{m}\) 的错误分布 \(F(e)\)。这意味着 \(e \leq-\bar{m}\) 的分布函数可以采用任何形状,只要它是弱递增的。这意味着未识别期望 \(\mathbb{E}[e]\),因此未识别 \(m(x)\)(回归的截距)的位置。

第二个重要假设是 \(e\) 独立于 \(X\)。鲍威尔 \((1984,1986)\) 在条件分位数框架中放宽了这一假设。模型是

\[ \begin{aligned} Y^{*} &=q_{\tau}(X)+e_{\tau} \\ \mathbb{Q}_{\tau}\left[e_{\tau} \mid X\right] &=0 \\ Y &=\max \left(Y^{*}, 0\right) \end{aligned} \]

对于一些 \(\tau \in(0,1)\)。该模型将 \(q_{\tau}(x)\) 定义为 \(\tau^{t h}\) 条件分位数函数。由于分位数与单调变换等变,我们有以下关系

\[ \mathbb{Q}_{\tau}[Y \mid X=x]=\max \left(q_{\tau}(x), 0\right) . \]

因此 \(Y\) 的条件分位数函数是 \(Y^{*}\) 的删失分位数函数。函数 \(\mathbb{Q}_{\tau}[Y \mid X=x]\) 由 \((Y, X)\) 的联合分布确定。因此,函数 \(q_{\tau}(x)\) 被识别为任何 \(x\),使得 \(q_{\tau}(x)>0\)。这是一个重要的概念突破。鲍威尔的结果表明,识别 \(q_{\tau}(x)\) 并不要求误差独立于 \(X\) 也不具有已知的分布。关键的见解是分位数,而不是均值,是从审查分布中非参数确定的。

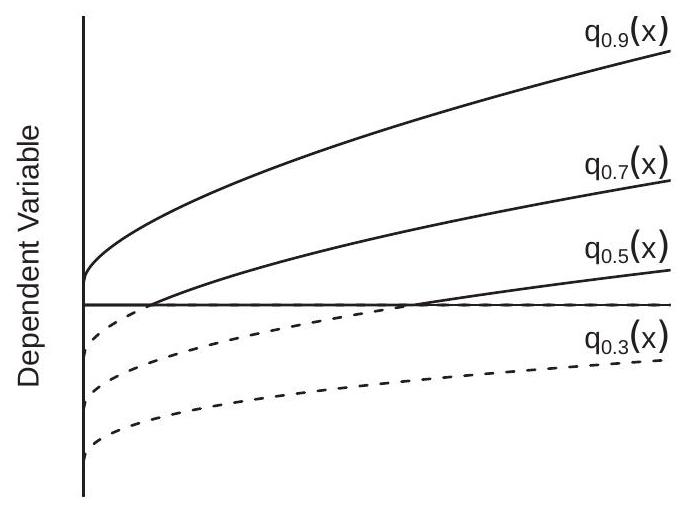

鲍威尔结果的一个限制是,函数 \(q_{\tau}(x)\) 只能在审查不超过 \(\tau %\) 的子群体上识别。

为了说明这一点,图 27.3(a) 显示了 \(\tau=0.3,0.5,0.7\) 的条件分位数函数 \(q_{\tau}(x)\),以及条件分布 \(Y^{*} \mid X \sim N\left(\sqrt{x}-\frac{3}{2}, 2+x\right)\) 的 \(0.9\)。高于零的部分(从截尾分布中识别)用实线绘制。低于零的部分(未从截尾分布中识别)用虚线绘制。我们可以看到,在这个例子中,分位数函数 \(q_{.9}(x)\) 被识别为 \(x\) 的所有值,分位数函数 \(q_{.3}(x)\) 未被识别为 \(x\) 的任何值,分位数函数 \(q_{.7}(x)\) 和 \(q_{\tau}(x)\) 被标识为 \(q_{\tau}(x)\) 值的子集。解释是,对于 \(q_{\tau}(x)\) 的任何固定值,我们仅观察审查分布 \(q_{\tau}(x)\),因此仅观察审查点上方的分位数。没有关于审查点以下 \(q_{\tau}(x)\) 分布的非参数信息。

(一)\(Y^{*} \mid X \sim \mathrm{N}\left(\sqrt{X}-\frac{3}{2}, 2+X\right)\)

.jpg)

- 收入对转移的影响

图 27.3:截尾回归分位数

27.7 CLAD 和 CQR 估计器

Powell \((1984,1986)\) 应用上一节中描述的分位数识别策略来开发简单的审查回归估计器。

Powell (1984) 中的模型是删失中值回归:

\[ \begin{aligned} Y^{*} &=X^{\prime} \beta+e \\ \operatorname{med}[e \mid X] &=0 \\ Y &=\max \left(Y^{*}, 0\right) . \end{aligned} \]

在此模型中,\(Y^{*}\) 潜藏于 \(\operatorname{med}\left[Y^{*} \mid X\right]=X^{\prime} \beta\) 中,\(Y\) 被审查为零。如上一节所述,中位数的等方差性质意味着 \(Y\) 的条件中位数等于

\[ \operatorname{med}[Y \mid X]=\max \left(X^{\prime} \beta, 0\right) . \]

这是 \(Y\) 的参数化非线性中值回归模型。

中值回归的适当估计量是最小绝对偏差 (LAD)。删失最小绝对偏差 (CLAD) 标准是

\[ M_{n}(\beta)=\frac{1}{n} \sum_{i=1}^{n}\left|Y_{i}-\max \left(X_{i}^{\prime} \beta, 0\right)\right| . \]

CLAD 估计器最小化 \(M_{n}(\beta)\)

\[ \widehat{\beta}_{\mathrm{CLAD}}=\underset{\beta}{\operatorname{argmin}} M_{n}(\beta) . \]

CLAD 准则 \(M_{n}(\beta)\) 与 LAD 准则具有相似的属性,即它是连续的、多面的且具有不连续的一阶导数。然而,一个重要的区别是 \(M_{n}(\beta)\) 不是全局凸的,因此最小化算法可能会收敛到局部最小值而不是全局最小值。 Powell (1986) 将 CLAD 扩展到截尾分位数回归 (CQR)。模型是

\[ \begin{aligned} Y^{*} &=X^{\prime} \beta+e \\ \mathbb{Q}_{\tau}[e \mid X] &=0 \\ Y &=\max \left(Y^{*}, 0\right) \end{aligned} \]

为 \(\tau \in(0,1)\)。等方差属性意味着 \(Y\) 的条件分位数函数是

\[ \mathbb{Q}_{\tau}[Y \mid X]=\max \left(X^{\prime} \beta, 0\right) . \]

CQR 标准是

\[ M_{n}(\beta ; \tau)=\frac{1}{n} \sum_{i=1}^{n} \rho_{\tau}\left(Y_{i}-\max \left(X_{i}^{\prime} \beta, 0\right)\right) \]

其中 \(\rho_{\tau}(u)\) 是检查函数 (24.10)。 CQR 估计器最小化了这个标准

\[ \widehat{\beta}_{\mathrm{CQR}}(\tau)=\underset{\beta}{\operatorname{argmin}} M_{n}(\beta ; \tau) . \]

对于 CLAD,标准不是全局凹的,因此不能保证数值最小化收敛到全局最小值。

Powell \((1984,1986)\) 表明 CLAD 和 CQR 估计量通过与分位数回归类似的论证而渐近正态。分位数回归的一个重要技术差异是 CLAD 和 CQR 估计量需要更强的识别条件。正如我们在上一节中讨论的,分位数函数 \(X^{\prime} \beta\) 仅针对其为正的区域进行识别。这意味着我们需要人口的正比例才能满足 \(X^{\prime} \beta>0\)。此外,相关设计矩阵(24.18)是在该子群上定义的,并且对于传统推理来说必须是满秩的。本质上,在没有审查的样本空间区域内,回归量必须有足够的变化。

CLAD 可以在 Stata 中使用附加包 clad 进行估算。在 R 中,可以使用 quantreg 包中的 crq 命令来估计 CLAD 和 CQR。

27.8 说明审查回归

为了说明方法,我们重新审视第 20.6 节中报告的应用程序,其中我们使用线性样条来估计 8684 个菲律宾家庭样本的收入对非政府转移的影响。最小二乘估计表明条件均值在 20,000 比索左右出现急剧不连续。因变量是国内、国外收到的转移以及实物(减去礼物)的总和。这四个子变量中的每一个都是非负的。如果我们将模型应用于任何这些子变量,就会出现大量的审查。为了说明这一点,我们将因变量设置为等于国内、国外和实物转移的总和,其审查比例为 \(18 %\)。这个比例足够高,如果忽略审查,我们应该预期会出现显着的审查偏差。

我们估计了与 \(20.6\) 节中报告并在图 20.2(b) 中显示的模型相同的模型,该模型是收入中的线性样条,具有 5 个节和 15 个附加控制回归量。我们使用四种方法估计方程:(a)最小二乘法; (b) 托比回归; (c) 法援署; (d) 复合材料。我们将估计的回归显示为收入的函数(其余回归量设置为样本均值),如图 27.3(b) 所示。

基本的见解——对于低收入水平,回归的斜率接近 \(-1\);对于高收入水平,回归是平坦的,在收入水平为 20,000 比索时出现急剧的不连续性——在四个估计中都非常稳健。然而,明显不同的是回归函数的水平。最小二乘估计比其他估计高出数千比索。 LAD 和 CLAD 估计值具有显着不同的水平这一事实不足为奇。因变量高度倾斜,因此均值和中位数差异很大(无条件均值和中位数分别为 7700 和 1200 )。这意味着回归函数的水平移动。然而,这并不能解释为什么托比特的估计也大幅下调。相反,这可以通过审查偏差来解释。由于回归函数呈负斜率,审查概率随着收入的增加而增加,因此最小二乘估计量的偏差为正,并且随着收入水平的增加而增加。尽管 LAD 估计不考虑审查,但 LAD 和 CLAD 估计非常相似。总体而言,CLAD 估计是首选,因为它们对于审查和非正态性都很稳健。

27.9 样本选择偏差

虽然计量经济学模型通常假设随机抽样,但实际观察结果通常是非随机收集的。如果选择(样本中的存在)是内生的,这可能会导致估计偏差。以下是潜在样本选择的示例。

1.工资回归。工资仅针对有工资收入的个人进行观察,这意味着该个人是劳动力的一员并且从事有工资的工作。工作决定可能与人的观察到和未观察到的特征有内在的联系。

方案评估。目标是通过试点计划衡量劳动力培训等计划的影响。当个体自愿参与(而不是随机分配)时,内生选择就会出现。自愿参加培训计划的个人可能具有与结果相关的能力。

调查。虽然调查可能是随机分布的,但完成调查的行为是非随机的。大多数调查的回复率都很低。当完成和返回调查的决定与调查答复相关时,就会出现内生选择。

评级。我们经常被要求对产品、服务和体验进行评分。大多数人不会回应该请求。当对产品进行评级的决定与响应相关时,就会出现内生选择。

为了理解样本选择的效果,将抽样视为一个两阶段过程很有用。在第一阶段,绘制随机变量 \((Y, X)\)。在第二阶段,该对要么被选入样本 \((S=1)\),要么被选入未观察到的 \((S=0)\)。然后,样本由\((Y, X)\) 和\(S=1\) 对组成。假设变量满足潜在回归模型 \(Y=X^{\prime} \beta+e\) 和 \(\mathbb{E}[e \mid X]=0\)。那么观察到的(选定的)样本中的 CEF 为

\[ \mathbb{E}[Y \mid X, S=1]=X^{\prime} \beta+\mathbb{E}[e \mid X, S=1] . \]

当第二项非零时,就会出现选择偏差。为了进一步理解这一点,假设对于某些错误 \(u\),选择可以建模为 \(S=\mathbb{1}\left\{X^{\prime} \gamma+u>0\right\}\)。这与潜在效用框架一致,其中 \(X^{\prime} \gamma+u\) 是参与的潜在效用。给定这个框架,我们可以将所选样本中 \(Y\) 的 CEF 写为

\[ \mathbb{E}[Y \mid X, S=1]=X^{\prime} \beta+\mathbb{E}\left[e \mid u>-X^{\prime} \gamma\right] . \]

令 \(e=\rho u+\varepsilon\) 为 \(e\) 在 \(u\) 上的投影。假设误差与 \(X\) 无关,并且 \(u\) 和 \(\varepsilon\) 相互独立。那么上面的表达式就等于

\[ \mathbb{E}[Y \mid X, S=1]=X^{\prime} \beta+\rho \mathbb{E}\left[u \mid u>-X^{\prime} \gamma\right]=X^{\prime} \beta+\rho g\left(X^{\prime} \gamma\right) \]

对于某些函数 \(g(u)\)。当 \(u \sim \mathrm{N}(0,1), g(u)=\phi(u) / \Phi(u)=\lambda(u)\) (参见练习 27.7)时,表达式等于

\[ \mathbb{E}[Y \mid X, S=1]=X^{\prime} \beta+\rho \lambda\left(X^{\prime} \gamma\right) . \]

这与特殊情况 \(\rho=\sigma\) 和 \(\gamma=\beta / \sigma\) 中的 (27.3) 相同。如图 27.2(a) 所示,这偏离了潜在的 \(\mathrm{CEF} X^{\prime} \beta\)

解释这种效应的一种方法是回归函数 (27.6) 包含两个分量:\(X^{\prime} \beta\) 和 \(\rho \lambda\left(X^{\prime} \gamma\right)\)。 \(X\) 的线性回归省略了第二项,因此继承了省略变量偏差,因为 \(X\) 和 \(\lambda\left(X^{\prime} \gamma\right)\) 是相关的。遗漏变量偏差的程度取决于 \(\rho\) 的大小,它是 \(e\) 在 \(u\) 上投影的系数。当错误 \(e\) 和 \(X^{\prime} \beta\) 独立时(当选择是外生的时),则 \(X^{\prime} \beta\) 和 (27.6) 简化为 \(X^{\prime} \beta\) 并且没有省略项。因此,当(且仅当)选择与方程误差相关时,才会出现样本选择偏差。

此外,如果斜率系数 \(\gamma\) 非零,则省略的选择项 \(\lambda\left(X^{\prime} \gamma\right)\) 仅影响估计的边际效应。相反,假设 \(X^{\prime} \gamma=\gamma_{0}\) 是一个常数。那么 (27.6) 等于 \(\mathbb{E}[Y \mid X, S=1]=\) \(X^{\prime} \beta+\rho \lambda\left(\gamma_{0}\right)\) 因此选择的影响是截距移位。如果我们的重点是边际效应,则仅当选择方程对回归变量 \(X\) 具有非平凡依赖性时,才会出现样本选择偏差。

在图 27.2(a) 中,我们看到审查削弱(压平)了回归函数。虽然选择 CEF (27.6) 采用类似的形式,但它范围更广,并且可以产生不同的影响。与审查情况相反,选择既可以使回归函数变陡,也可以使回归函数变平。一般来说,很难预测选择对回归函数的影响。

正如我们所表明的,内生选择改变了条件期望。如果样本是通过内生选择生成的,那么对感兴趣的参数的估计将会有偏差。如果没有有关选择过程的信息,除了意识到偏见的存在之外,几乎无法“纠正”偏见。在下一节中,我们讨论一种当我们掌握有关选择过程的信息时纠正样本选择偏差的方法。

27.10 赫克曼模型

Heckman (1979) 表明,如果我们有一个包含未选择的观察值的样本,则可以纠正样本选择偏差。假设观测值 \(\left\{Y_{i}, X_{i}, Z_{i}\right\}\) 是随机样本,其中 \(Y\) 是选定变量(例如工资,只有当一个人有工资收入时才会观测到)。 Heckman 的方法是建立完整样本(而不仅仅是所选样本)的联合模型,并用它来估计模型参数。

赫克曼的模型是

\[ \begin{aligned} Y^{*} &=X^{\prime} \beta+e \\ S^{*} &=Z^{\prime} \gamma+u \\ S &=\mathbb{1}\left\{S^{*}>0\right\} \\ Y &=\left\{\begin{array}{cc} Y^{*} & \text { if } S=1 \\ \text { missing } & \text { if } S=0 \end{array}\right. \end{aligned} \]

和

\[ \left(\begin{array}{c} e \\ u \end{array}\right) \sim \mathrm{N}\left(0,\left(\begin{array}{cc} \sigma^{2} & \sigma_{21} \\ \sigma_{21} & 1 \end{array}\right)\right) \]

该模型指定潜在变量 \(Y^{*}\) 和 \(S^{*}\) 在回归量 \(X\) 和 \(Z\) 中呈线性,并具有结构错误 \(e\) 和 \(u\)。变量 \(S\) 表示选择并遵循概率方程。如果选择 \(Y^{*}\),则变量 \(Y\) 等于潜在变量 \(Y^{*}\),否则缺失。该模型指定误差与协方差 \(Y^{*}\) 共同呈正态。 \(Y^{*}\) 的方差未识别,因此标准化为等于 1 。

在 Heckman 的经典示例中,\(Y^{*}\) 是个人在就业时将收到的工资(或 log(wage)),\(S\) 是就业状态,\(Y\) 是观察工资。系数 \(\beta\) 是工资回归的系数;系数 \(\gamma\) 是决定就业状况的系数。误差\(e\)是决定个人工资的未观察到的能力和其他未观察到的因素;错误\(u\)是决定就业状况的未观察因素;并且两者很可能是相关的。

基于与上一节讨论的相同计算,所选样本中 \(Y\) 的 CEF 为

\[ \mathbb{E}[Y \mid X, Z, S=1]=X^{\prime} \beta+\sigma_{21} \lambda\left(Z^{\prime} \gamma\right) \]

其中 \(\lambda(x)\) 是逆米尔斯比率。

赫克曼提出了系数的两步估计器。我们的见解是,系数 \(\gamma\) 通过 \(S\) 在 \(Z\) 上的概率回归来确定。给定 \(\gamma\),系数 \(\beta\) 和 \(\sigma_{21}\) 通过使用所选样本对 \(\left(X, \lambda\left(Z^{\prime} \gamma\right)\right)\) 进行 \(Y\) 的最小二乘回归来识别。步骤如下。

根据观察到的序列 \(Y\) 构造(如有必要)二元变量 \(S\)。

通过 \(S\) 在 \(Z\) 上的概率回归来估计系数 \(\widehat{\gamma}\)。

构造变量\(\widehat{\lambda}_{i}=\lambda\left(Z_{i}^{\prime} \widehat{\gamma}\right)\)。

使用 \(S_{i}=1\) 的子样本,通过 \(Y_{i}\) 在 \(\left(X_{i}, \widehat{\lambda}_{i}\right)\) 上的最小二乘回归来估计系数 \(\left(\widehat{\beta}, \widehat{\sigma}_{21}\right)\)。

Heckman 证明估计量 \(\widehat{\beta}\) 是一致的且渐近正态的。变量 \(\widehat{\lambda}_{i}\) 是一个生成的回归量(参见第 12.26 节),它影响协方差矩阵估计。该方法有时称为“Heckit”,因为它是概率、logit 和 Tobit 回归的模拟。

作为副产品,我们获得了协方差的估计量 \(\sigma_{21}\)。该参数表示样本选择内生性的大小。如果选择是外生的,那么\(\sigma_{21}=0\)。外生选择的原假设可以通过检查 \(\widehat{\sigma}_{21}\) 的 t 统计量来检验。

两步估计的替代方法是联合最大似然。 \(S\) 和 \(Y\) 的联合密度为

\[ f(s, y \mid x, z)=\mathbb{P}[S=0 \mid x, z]^{1-s} f(y, S=1 \mid x, z)^{s} \text {. } \]

选择概率为\(\mathbb{P}[S=0 \mid x, z]=1-\Phi\left(z^{\prime} \gamma\right)\)。条件密度分量是

\[ \begin{aligned} f(y, S=1, \mid x, z) &=\int_{0}^{\infty} f\left(y, s^{*} \mid x, z\right) d s^{*} \\ &=\int_{0}^{\infty} f\left(s^{*} \mid y, x, z\right) f(y \mid x, z) d s^{*} \\ &=\left(1-F\left(s^{*} \mid y, x, z\right)\right) f(y \mid x, z) . \end{aligned} \]

第一个等式成立,因为 \(S=1\) 与 \(S^{*}>0\) 相同。第二个将联合密度分解为给定 \(Y\) 的 \(S^{*}\) 条件和 \(Y\) 边际的乘积。 \(Y\) 的边际密度是 \(\sigma^{-1} \phi\left(\left(y-x^{\prime} \beta\right) / \sigma\right)\)。给定 \(Y\) 时,\(S^{*}\) 的条件分布是 \(S=1\)。通过这些替换,我们获得了联合混合密度

\[ f(s, y \mid x, z)=\left(1-\Phi\left(z^{\prime} \gamma\right)\right)^{1-s}\left[\Phi\left(\frac{z^{\prime} \gamma+\frac{\sigma_{21}}{\sigma^{2}}\left(y-x^{\prime} \beta\right)}{\sqrt{1-\frac{\sigma_{21}}{\sigma^{2}}}}\right) \frac{1}{\sigma} \phi\left(\frac{y-x^{\prime} \beta}{\sigma}\right)\right]^{s} . \]

根据观察值进行评估,我们获得对数似然函数

\[ \ell_{n}\left(\beta, \gamma, \sigma^{2}, \sigma_{21}\right)=\sum_{S_{i}=0} \log \left(1-\Phi\left(Z_{i}^{\prime} \gamma\right)\right)+\sum_{S_{i}=1}\left[\log \Phi\left(\frac{Z_{i}^{\prime} \gamma+\frac{\sigma_{21}}{\sigma^{2}}\left(Y_{i}-X_{i}^{\prime} \beta\right)}{\sqrt{1-\frac{\sigma_{21}}{\sigma^{2}}}}\right)-\frac{1}{2} \log \left(2 \pi \sigma^{2}\right)-\frac{1}{2 \sigma^{2}}\left(Y_{i}-X_{i}^{\prime} \beta\right)^{2}\right] \]

最大似然估计器 \(\left(\widehat{\beta}, \widehat{\gamma}, \widehat{\sigma}^{2}, \widehat{\sigma}_{21}\right)\) 最大化对数似然。

MLE 是最终报告的首选估计方法。然而,在某些应用中,它的计算要求可能很高,因此两步估计器对于初步分析非常有用。

在 Stata 中,可以使用 heckman 命令获得两步估计器和联合 MLE。

27.11 非参数选择

非参数选择模型是

\[ \begin{aligned} Y^{*} &=m(X)+e \\ S^{*} &=g(Z)+u \\ S &=\mathbb{1}\left\{S^{*}>0\right\} \\ Y &=\left\{\begin{array}{cc} Y^{*} & \text { if } S=1 \\ \text { missing } & \text { if } S=0 \end{array}\right. \end{aligned} \]

其中 \((e, u)\) 的分布未知。为简单起见,我们假设 \((e, u)\) 独立于 \((X, Z)\)。

如果 \(u>-g(Z)\) 则发生选择。这不受单调递增变换的影响。因此,\(u\) 的分布不会与函数 \(g(Z)\) 分开识别。因此,我们可以将 \(u\) 的分布标准化为方便的形式。这里我们使用正态分布:\(u \sim \Phi(x)\)。

由于函数 \(m(X)\) 和 \(g(Z)\) 是非参数函数,我们可以在适当的变量变换后使用级数方法通过 \(m(X)=X^{\prime} \beta\) 和 \(g(Z)=Z^{\prime} \gamma\) 形式的线性模型来近似它们。我们将使用后一种表示法将模型与估计方法联系起来。

选择的条件概率为

\[ p(Z)=\mathbb{P}[S=1 \mid Z]=\mathbb{P}\left[u>-Z^{\prime} \gamma \mid Z\right]=\Phi\left(Z^{\prime} \gamma\right) . \]

概率 \(p(Z)\) 称为倾向得分;它是从 \((S, Z)\) 的联合分布中非参数识别的,因此函数 \(g(Z)=Z^{\prime} \gamma\) 被识别。系数 \(\gamma\) 和倾向得分可以通过二元选择方法来估计,例如通过级数概率回归。

给定选择的 \(Y\) 的 CEF 为

\[ \mathbb{E}[Y \mid X, Z, S=1]=X^{\prime} \beta+h_{1}\left(Z^{\prime} \gamma\right) \]

其中 \(h_{1}(x)=\mathbb{E}[e \mid u>-x]\).一般来说,\(h_{1}(x)\) 可以采用一系列可能的形状。当 \((e, u)\) 与协方差 \(\sigma_{21}\) 联合正态时,\(h_{1}(x)=\sigma_{21} \lambda(x)\) 则为 \(\lambda(x)=\phi(x) / \Phi(x)\),其中 \(\lambda(x)=\phi(x) / \Phi(x)\) 是逆米尔斯比率。 CEF 有两种可能有用的替代表示形式。由于 \(g(Z)=\Phi^{-1}(p(Z))\) 我们有表示

\[ \left.\mathbb{E}[Y \mid X, Z, S=1]=X^{\prime} \beta+h_{2}(p(Z))\right) \]

其中 \(h_{2}(x)=h_{1}\left(\Phi^{-1}(x)\right)\).另外,因为 \(\lambda(x)\) 是可逆的,我们有表示

\[ \mathbb{E}[Y \mid X, Z, S=1]=X^{\prime} \beta+h_{3}\left(\lambda\left(Z^{\prime} \gamma\right)\right) \]

其中 \(h_{3}(x)=h_{1}\left(\lambda^{-1}(x)\right)\).

三个方程 (27.8)-(27.10) 提出了我们现在描述的三种非参数估计的两步方法。每个都基于 \(\gamma\) 的第一步二元选择估计器 \(\widehat{\gamma}\)。

方程 (27.8) 表明 \(Y\) 对 \(X\) 进行回归,并在 \(Z^{\prime} \widehat{\gamma}\) 中进行级数展开,例如 \(Z^{\prime} \widehat{\gamma}\) 中的低阶多项式

方程 (27.9) 表明 \(Y\) 对 \(X\) 进行回归,并在倾向得分 \(\widehat{p}=\) \(\Phi\left(Z^{\prime} \widehat{\gamma}\right)\) 中进行级数展开,例如 \(\hat{p}\) 中的低阶多项式。

方程 (27.10) 表明 \(Y\) 对 \(X\) 进行回归,并在 \(\hat{\lambda}=\lambda\left(Z^{\prime} \hat{\gamma}\right)\) 中进行级数展开,例如 \(\hat{\lambda}\) 中的低阶多项式。

基于 (27.10) 的展开式的优点是,它在正态分布的主要情况下将是一阶精确的。这意味着对于接近正态分布,即使项数很少,级数展开也将是准确的。基于(27.9)的扩展的优点是可解释性:回归被表示为倾向得分的函数。

Das、Newey 和 Vella (2003) 为此类估计量提供了详细的渐近理论,重点关注基于 (27.9) 的估计量。它们提供了模型被识别、估计量一致且渐近正态分布的条件。

这些非参数选择估计器是带有生成回归器的两步估计器(参见第 12.26 节)。因此,传统的协方差矩阵估计量和标准误差是不一致的。可以使用 GMM 构建渐近有效的协方差矩阵估计器。另一种方法是使用引导方法。后者应作为显式两步估计器实现,以便通过引导分布处理第一步估计。

标准建议是,选择方程中的回归量 \(Z\) 应包含至少一个相关变量,该变量可有效排除主方程中的回归量 \(X\)。原因是否则 \(m(x)\) 和 \(h\left(Z^{\prime} \gamma\right)\) 的级数展开可能是高度共线的并且不能单独识别。这种见解也适用于参数化情况。一个困难是,在应用程序中,识别影响选择 \(S^{*}\) 但不影响结果 \(Y^{*}\) 的变量可能具有挑战性。

27.12 面板数据

面板删失回归(面板 Tobit)方程为

\[ \begin{aligned} &Y_{i t}^{*}=X_{i t}^{\prime} \beta+u_{i}+e_{i t} \\ &Y_{i t}=\max \left(Y_{i t}^{*}, 0\right) . \end{aligned} \]

个体效应 \(u_{i}\) 可以被视为随机效应(与误差不相关)或固定效应(非结构化相关)。

可以在误差联合正态性的假设下导出随机效应估计量。这是在 Stata 命令 xttobit 中实现的。优点是流程简单,实现起来简单。缺点通常与随机效应估计器相关。

Honoré (1992) 开发了固定效应估计器。他的主要见解如下,我们假设 \(T=2\) 进行说明。如果误差 \(\left(e_{i 1}, e_{i 2}\right)\) 与 \(\left(X_{i 1}, X_{i 2}, u_{i}\right)\) 无关,则以 \(\left(X_{i 1}, X_{i 2}\right)\) 为条件的 \(\left(Y_{i 1}^{*}, Y_{i 2}^{*}\right)\) 的分布关于通过 \(\left(Y_{1}, Y_{2}\right)\) 空间中的点 \(\left(\Delta X^{\prime} \beta, 0\right)\) 的 45 度线对称。该分布不依赖于固定效应 \(u_{i}\)。根据这种对称性和审查规则,Honoré 导出了矩条件,该条件可识别系数 \(\beta\) 并允许通过 GMM 进行估计。 Honoré (1992) 提供了完整的渐近分布理论。 Honoré 提供了 Stata 命令 Pantob,该命令实现了他的估计器,并且可以在他的网站上找到。 Honore/stata/。面板样本选择模型为

\[ \begin{aligned} Y_{i t}^{*} &=X_{i t}^{\prime} \beta+u_{i}+e_{i t} \\ S_{i t}^{*} &=Z_{i t}^{\prime} \gamma+\eta_{i}+v_{i t} \\ S_{i t} &=\mathbb{1}\left\{S_{i t}^{*}>0\right\} \\ Y_{i t} &=\left\{\begin{array}{cc} Y_{i t}^{*} & \text { if } S_{i t}=1 \\ \text { missing } & \text { if } S_{i t}=0 \end{array}\right. \end{aligned} \]

Kyriazidou (1997) 提出了一种估计该模型的方法。为了便于说明,我们再次关注 \(T=2\) 案例。她的估计器的动机是观察到 \(\beta\) 可以通过应用于子样本的最小二乘法来一致估计,其中 \(S_{i 1}=S_{i 2}=1\) (两个观测值都被选择)和 \(Z_{i 1}^{\prime} \gamma=Z_{i 2}^{\prime} \gamma\) (两个观测值具有相同的选择概率)。参数 \(\gamma\) 通过选择方程按比例确定,因此可以通过 \(25.13\) 节中描述的方法估计为 \(\widehat{\gamma}\)(例如 Chamberlain (1980, 1984))。给定 \(\hat{\gamma}\),我们通过 \(T=2\) 子样本上的核加权最小二乘法估计 \(\beta\),核权重取决于 \(T=2\)。 Kyriazidou (1997) 提供了完整的分布理论。

27.13 练习

练习27.1 推导(27.2)和(27.3)。提示:使用经济学家概率与统计定理 \(5.7\) 和 \(5.8\)。

练习27.2 建立模型

\[ \begin{aligned} Y^{*} &=X^{\prime} \beta+e \\ e & \sim \mathrm{N}\left(0, \sigma^{2}\right) \\ Y &=\left\{\begin{array}{cc} Y^{*} & \text { if } Y^{*} \leq \tau \\ \text { missing } & \text { if } Y^{*}>\tau \end{array} .\right. \end{aligned} \]

在此模型中,我们说 \(Y\) 从上方受到限制。假设您在 \(X\) 上回归 \(Y\)。 OLS 对于 \(\beta\) 是否一致?描述错误测量的观测值对 OLS 估计量的影响的性质。

练习27.3 建立模型

\[ \begin{aligned} Y &=X^{\prime} \beta+e \\ e & \sim \mathrm{N}\left(0, \sigma^{2}\right) . \end{aligned} \]

让 \(\widehat{\beta}\) 表示基于可用样本的 \(\beta\) 的 OLS 估计器。

假设仅当 \(X_{1}>0\)(其中 \(X_{1}\) 是 \(X\) 的元素)时观测值才在样本中。 \(\widehat{\beta}\) 与 \(\beta\) 一致吗?获得其概率极限的表达式。

假设仅当 \(Y>0\) 时观测值才出现在样本中。 \(\widehat{\beta}\) 与 \(\widehat{\beta}\) 一致吗?获得其概率极限的表达式。

练习 27.4 对于截尾条件均值 (27.2),提出 \((\beta, \sigma)\) 的 NLLS 估计量。

练习 27.5 对于截断的条件均值 (27.3),提出 \((\beta, \sigma)\) 的 NLLS 估计量。练习 27.6 潜变量 \(Y^{*}\) 生成为

\[ \begin{gathered} Y^{*}=\beta_{0}+X \beta_{1}+e \\ e \mid X \sim \mathrm{N}\left(0, \sigma^{2}(X)\right) \\ \sigma^{2}(X)=\gamma_{0}+X^{2} \gamma_{1} \\ Y=\max \left(Y^{*}, 0\right) . \end{gathered} \]

其中 \(X\) 是标量。假设 \(\gamma_{0}>0\) 和 \(\gamma_{1}>0\)。参数是 \(\beta, \gamma_{0}, \gamma_{1}\)。求给定 \(X\) 的 \(Y\) 条件分布的对数似然函数。

练习27.7 建立模型

\[ \begin{aligned} S &=\mathbb{1}\left\{X^{\prime} \gamma+u>0\right\} \\ Y &=\left\{\begin{array}{cc} X^{\prime} \beta+e & \text { if } S=1 \\ \text { missing } & \text { if } S=0 \end{array}\right.\\ \left(\begin{array}{c} e \\ u \end{array}\right) & \sim \mathrm{N}\left(0,\left(\begin{array}{cc} \sigma^{2} & \sigma_{21} \\ \sigma_{21} & 1 \end{array}\right)\right) \end{aligned} \]

显示\(\mathbb{E}[Y \mid X, S=1]=X^{\prime} \beta+\sigma_{21} \lambda\left(X^{\prime} \gamma\right)\)。

练习27.8 显示(27.7)。

练习27.9 获取\(\mathrm{CH} \mathrm{J} 2004\)数据集。变量tinkind和收入分别是家庭收到的实物转移和家庭收入。将两个变量除以 1000 进行标准化。创建回归量 D 收入 \(=(\) 收入 \(-1) \times \mathbb{1}\{\) 收入 \(>1\}\)。

估计 Tinkind 对收入和 D 收入的线性回归。解释结果。

计算审查观测值的百分比(tinkind= 0 的百分比。您认为审查偏差会成为此示例中的问题吗?

假设您尝试通过省略删失观察来解决问题。估计tinkind \(>0\) 观测子样本的回归。

估计 Tinkind 对收入和 D 收入的 Tobit 回归。

使用 CLAD 估计相同的回归。

解释并解释 (a)-(e) 中结果之间的差异。

练习 27.10 采用 cps09mar 数据集和受过至少 12 年教育的个人的子样本。创建工资 \(=\) 收入/(小时 \(\times\) 周 \()\) 和 lwage \(=\log (\) 工资 \()\)。

估计 lwage 对教育和教育 \({ }^{\wedge}\) 的线性回归。解释结果。

假设工资数据的上限约为 \(\$ 30\)/小时。创建一个变量 cwage,lwage 上限为 3.4。估计工资对教育和教育的线性回归 \(\wedge\) 2. 如果您不知道因变量有上限,您将如何解释这些结果?

假设您尝试通过忽略上限观测值来解决问题。估计 cwage 小于 3.4 的观测子样本的回归。 (d) 估计 cwage 对教育和 education^{}2 的 Tobit 回归,并在 \(3.4\) 处进行上层审查。

使用 CLAD 估计相同的回归。您可能需要施加 3.3 的上限审查。

解释并解释 (a)-(e) 中结果之间的差异。

练习27.11 获取DDK2011数据集。创建一个变量测试分数,将总分数标准化为均值零和方差一。变量跟踪是一个虚拟变量,表明学生已被跟踪(按初始测试分数分隔)。变量百分位数是学生在初始分布中的百分位数。对于以下回归按学校进行聚类。

估计跟踪、百分位和百分位测试分数的线性回归^{}2。解释结果。

假设分数是自下而上审查的。创建一个变量 ctest ,其 testscore 删失为 0 。估计 ctest 对跟踪、百分位数和百分位数 \({ }^{\wedge}\) 的线性回归。如果您不知道因变量已被审查,您将如何解释这些结果?

假设您尝试通过省略删失观察来解决问题。估计 ctest 为正的观测子样本的回归。

解释并解释 (a)、(b) 和 (c) 中结果之间的差异。