第12章: 工具变量

12 工具变量

12.1 介绍

内生性和工具变量的概念是计量经济学的基础,并且标志着与统计学其他分支的重大区别。内生性的思想在经济学中自然地从联立方程模型中产生,最著名的是价格决定的经典供需模型。

联立方程中的辨识问题可以追溯到 Philip Wright (1915) 和 Work (1927)。工具变量方法首次出现在菲利普·赖特 1928 年所著书籍的附录中,尽管作者有时被认为是他的儿子休厄尔·赖特 (Sewell Wright)。 “工具变量”这个标签是由 Reiersøl (1945) 引入的。 Stock 和 Trebbi (2003) 对工具变量的历史进行了精彩的回顾。

12.2 概述

我们说线性模型存在内生性

\[ Y=X^{\prime} \beta+e \]

如果 \(\beta\) 是感兴趣的参数并且

\[ \mathbb{E}[X e] \neq 0 \text {. } \]

这是计量经济学的核心问题,并且在很大程度上将该领域与统计学区分开来。为了区分(12.1)与回归和投影模型,我们将(12.1)称为结构方程,\(\beta\)称为结构参数。当 (12.2) 成立时,通常说 \(X\) 对于 \(\beta\) 是内生的。

如果系数由线性投影定义,则不会发生内生性。事实上,我们可以定义线性投影系数 \(\beta^{*}=\mathbb{E}\left[X X^{\prime}\right]^{-1} \mathbb{E}[X Y]\) 和线性投影方程

\[ \begin{aligned} Y &=X^{\prime} \beta^{*}+e^{*} \\ \mathbb{E}\left[X e^{*}\right] &=0 . \end{aligned} \]

然而,在内生性 (12.2) 下,投影系数 \(\beta^{*}\) 不等于结构参数 \(\beta\)。的确,

\[ \begin{aligned} \beta^{*} &=\left(\mathbb{E}\left[X X^{\prime}\right]\right)^{-1} \mathbb{E}[X Y] \\ &=\left(\mathbb{E}\left[X X^{\prime}\right]\right)^{-1} \mathbb{E}\left[X\left(X^{\prime} \beta+e\right)\right] \\ &=\beta+\left(\mathbb{E}\left[X X^{\prime}\right]\right)^{-1} \mathbb{E}[X e] \neq \beta \end{aligned} \]

最终的关系是因为\(\mathbb{E}[X e] \neq 0\)。

因此,内生性要求系数的定义与投影不同。我们将此类定义描述为结构性的。我们将在下一节中展示三个示例。

内生性意味着最小二乘估计量对于结构参数是不一致的。事实上,根据 i.i.d.采样,最小二乘对于投影系数是一致的。

\[ \widehat{\beta} \underset{p}{\longrightarrow}\left(\mathbb{E}\left[X X^{\prime}\right]\right)^{-1} \mathbb{E}[X Y]=\beta^{*} \neq \beta . \]

最小二乘法的不一致通常被称为内生性偏差或内生性导致的估计偏差。这是一个不完美的标签,因为实际问题是不一致,而不是偏见。

由于结构参数 \(\beta\) 是感兴趣的参数,内生性需要开发替代估计方法。我们将在后面的部分中讨论这些内容。

12.3 例子

通过例子可能最容易理解内生性的概念。我们讨论三个。在每种情况下,重要的是要了解结构参数 \(\beta\) 是如何独立于线性投影模型定义的。

示例:回归器中的测量误差。假设 \((Y, Z)\) 是联合随机变量,\(\mathbb{E}[Y \mid Z]=Z^{\prime} \beta\) 是线性变量,\(\beta\) 是结构参数。未观察到 \(Z\)。相反,我们观察 \(X=Z+u\),其中 \(u\) 是 \(k \times 1\) 测量误差,与 \(e\) 和 \(Z\) 无关。这是潜在变量模型的示例,其中“潜在”指的是未观察到的结构变量。

\(Z\) 和 \(u\) 独立且 \(\mathbb{E}[u]=0\) 的模型 \(X=Z+u\) 被称为经典测量误差。这意味着 \(X\) 是 \(Z\) 的一个有噪声但无偏差的度量。

通过替换,我们可以将 \(Y\) 表示为观察变量 \(X\) 的函数。

\[ Y=Z^{\prime} \beta+e=(X-u)^{\prime} \beta+e=X^{\prime} \beta+v \]

其中 \(v=e-u^{\prime} \beta\).这意味着 \((Y, X)\) 满足线性方程

\[ Y=X^{\prime} \beta+v \]

出现错误 \(v\)。但这个错误不是投影错误。的确,

\[ \mathbb{E}[X v]=\mathbb{E}\left[(Z+u)\left(e-u^{\prime} \beta\right)\right]=-\mathbb{E}\left[u u^{\prime}\right] \beta \neq 0 \]

如果 \(\beta \neq 0\) 和 \(\mathbb{E}\left[u u^{\prime}\right] \neq 0\)。正如我们在上一节中了解到的,如果 \(\mathbb{E}[X \nu] \neq 0\) 则最小二乘估计将不一致。

我们可以计算出投影系数的形式(一致地通过最小二乘估计)。为简单起见,假设 \(k=1\)。我们发现

\[ \beta^{*}=\beta+\frac{\mathbb{E}[X \nu]}{\mathbb{E}\left[X^{2}\right]}=\beta\left(1-\frac{\mathbb{E}\left[u^{2}\right]}{\mathbb{E}\left[X^{2}\right]}\right) . \]

由于 \(\mathbb{E}\left[u^{2}\right] / \mathbb{E}\left[X^{2}\right]<1\) 投影系数将结构参数 \(\beta\) 缩小到零。这称为测量误差偏差或衰减偏差。

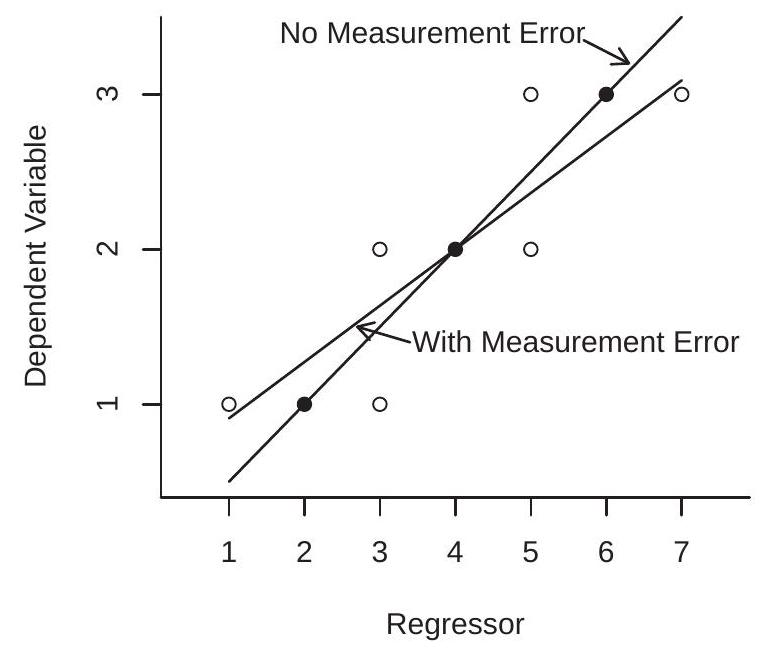

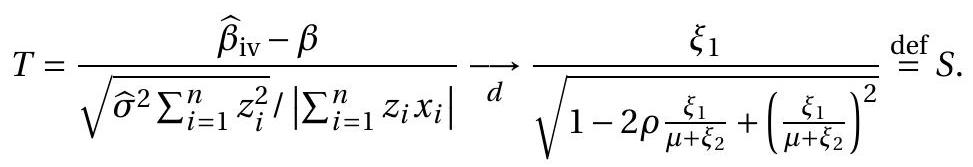

为了说明这一点,图 12.1(a) 显示了测量误差对回归线的影响。这三个实心点是对 \((Y, Z)\) 的测量,没有误差。通过这三个点绘制的回归函数被标记为“无测量误差”。六个空心圆圈标记对 \((Y, X)\),其中 \(X=Z+u\) 与 \(u=\{+1,-1\}\)。因此 \(X\) 是 \(Z\) 的错误测量版本。六个空心圆沿 \(\mathrm{x}\) 轴展开联合分布,但不沿 \(\mathrm{y}\) 轴展开。为这六个点绘制的回归线被标记为“有测量误差”。您可以看到后面的回归线相对于原始回归函数是平坦的。这是由于测量误差引起的衰减偏差。

- 测量误差

.jpg)

- 供给与需求

图 12.1:内生性示例

示例:供给和需求。变量 \(Q\) 和 \(P\)(数量和价格)由需求方程共同确定

\[ Q=-\beta_{1} P+e_{1} \]

和供给方程

\[ Q=\beta_{2} P+e_{2} \text {. } \]

假设 \(e=\left(e_{1}, e_{2}\right)\) 满足 \(\mathbb{E}[e]=0\) 和 \(\mathbb{E}\left[e e^{\prime}\right]=\boldsymbol{I}_{2}\)(为简单起见,后者)。问题是:如果我们将 \(Q\) 回归到 \(P\) 上,会发生什么?

解决 \(Q\) 和 \(P\) 的错误很有帮助。用矩阵表示法来说,

\[ \left[\begin{array}{cc} 1 & \beta_{1} \\ 1 & -\beta_{2} \end{array}\right]\left(\begin{array}{l} Q \\ P \end{array}\right)=\left(\begin{array}{l} e_{1} \\ e_{2} \end{array}\right) \]

所以

\[ \begin{aligned} \left(\begin{array}{l} Q \\ P \end{array}\right) &=\left[\begin{array}{cc} 1 & \beta_{1} \\ 1 & -\beta_{2} \end{array}\right]^{-1}\left(\begin{array}{c} e_{1} \\ e_{2} \end{array}\right) \\ &=\left[\begin{array}{cc} \beta_{2} & \beta_{1} \\ 1 & -1 \end{array}\right]\left(\begin{array}{l} e_{1} \\ e_{2} \end{array}\right)\left(\frac{1}{\beta_{1}+\beta_{2}}\right) \\ &=\left(\begin{array}{c} \left(\beta_{2} e_{1}+\beta_{1} e_{2}\right) /\left(\beta_{1}+\beta_{2}\right) \\ \left(e_{1}-e_{2}\right) /\left(\beta_{1}+\beta_{2}\right) \end{array}\right) . \end{aligned} \]

\(Q\) 在 \(P\) 上的投影产生 \(Q=\beta^{*} P+e^{*}\) 和 \(\mathbb{E}\left[P e^{*}\right]=0\),投影系数为

\[ \beta^{*}=\frac{\mathbb{E}[P Q]}{\mathbb{E}\left[P^{2}\right]}=\frac{\beta_{2}-\beta_{1}}{2} . \]

投影系数 \(\beta^{*}\) 既不等于需求斜率 \(\beta_{1}\) 也不等于供给斜率 \(\beta_{2}\),而是等于两者的平均值。 (它是简单平均值这一事实是协方差结构的产物。)

OLS 估计器满足 \(\widehat{\beta} \underset{p}{\rightarrow} \beta^{*}\) 并且极限不等于 \(\beta_{1}\) 或 \(\beta_{2}\)。这称为联立方程偏差。当 \(Y\) 和 \(X\) 共同确定时(如市场均衡),这种情况通常会发生。

一般来说,当同时确定因变量和回归变量时,则应将回归变量视为内生变量。

为了说明这一点,图 12.1(b) 绘制了一个供需模型,其中 y 轴为数量,\(\mathrm{x}\) 轴为价格。供给和需求方程分别为 \(Q=P+\varepsilon_{1}\) 和 \(Q=4-P-\varepsilon_{2}\)。假设每个错误都具有 Rademacher 分布 \(\varepsilon \in\{-1,+1\}\)。该模型有四种均衡结果,由图中的四个点标记。通过这四个点的回归线的斜率为零,并标记为“回归”。这是通过观察数量对观察价格的最小二乘回归来衡量的。这是由于同时性而产生的内生性偏差。

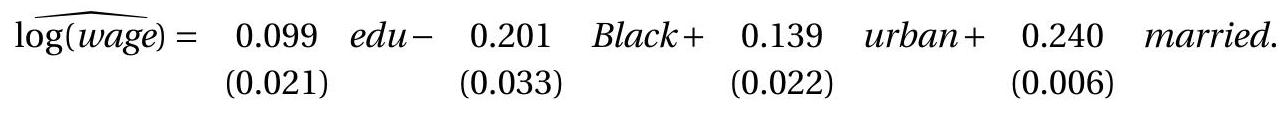

示例:选择变量作为回归量。采用经典的工资方程

\[ \log (\text { wage })=\beta \text { education }+e \]

\(\beta\) 是教育对工资的平均因果效应。如果工资受到不可观测能力的影响,并且能力高的个体自我选择接受高等教育,则\(e\)包含不可观测能力,因此教育和\(e\)将呈正相关。因此,教育是内生的。正相关意味着线性投影系数 \(\beta^{*}\) 将相对于结构系数 \(\beta\) 向上偏置。因此,最小二乘法(估计投影系数)往往会高估教育对工资的因果影响。

这种类型的内生性通常发生在 \(Y\) 和 \(X\) 都是经济主体做出的选择时,即使它们是在不同的时间点做出的。

一般来说,当因变量和回归变量都是同一主体做出的选择变量时,这些变量应被视为内生变量。

这个例子在图 \(2.8\) 中得到了说明,它显示了 Jennifers 和 Georges 人口的工资和教育的联合分布。在图 2.8 中,绘制的平均因果效应是大学教育对工资的结构性影响(人口平均)。绘制的回归线具有较大的斜率,因为由于教育是一个选择变量,它增加了内生性偏差。

12.4 内生回归因子

我们将内生性定义为回归量与方程误差相关的背景。内生性的反面是外生性。也就是说,如果 \(\mathbb{E}[X e]=\) 0 ,我们说回归量 \(X\) 对于 \(\beta\) 是外生的。一般来说,经济模型的区别在于,如果回归量 \(X\) 与 \(Y\) 共同确定,则它是内生的;而如果回归量 \(X\) 与 \(Y\) 单独确定,则它是外生的。

在大多数应用中,只有一部分回归量被视为内生的。使用维度 \(\left(k_{1}, k_{2}\right)\) 对 \(X=\left(X_{1}, X_{2}\right)\) 进行分区,以便 \(X_{1}\) 包含外生回归量,\(X_{2}\) 包含内生回归量。由于因变量 \(Y\) 也是内生的,因此我们有时通过将其称为内生右侧变量来区分 \(X_{2}\)。类似地对 \(\beta=\left(\beta_{1}, \beta_{2}\right)\) 进行分区。使用这种符号,结构方程为

\[ Y=X_{1}^{\prime} \beta_{1}+X_{2}^{\prime} \beta_{2}+e . \]

另一种表示法如下。令 \(Y_{2}=X_{2}\) 为内生回归量,并将因变量 \(Y\) 重命名为 \(Y_{1}\)。那么结构方程为

\[ Y_{1}=X_{1}^{\prime} \beta_{1}+Y_{2}^{\prime} \beta_{2}+e . \]

这特别有用,因为符号可以阐明哪些变量是内生的,哪些是外生的。我们还将 \(\vec{Y}=\left(Y_{1}, Y_{2}\right)\) 写为内生变量集。我们使用符号\(\vec{Y}\),这样就不会与(12.3)中定义的\(Y\)混淆。

关于回归量和回归误差的假设是

\[ \begin{aligned} &\mathbb{E}\left[X_{1} e\right]=0 \\ &\mathbb{E}\left[Y_{2} e\right] \neq 0 . \end{aligned} \]

内生回归量 \(Y_{2}\) 是上一节示例中讨论的关键变量 - 联立变量、选择变量、误测回归量 - 可能与方程误差 \(e\) 相关。在许多应用中 \(k_{2}\) 很小(1 或 2 )。外生变量 \(X_{1}\) 是剩余的回归量(包括方程截距),可以是低维或高维的。

12.5 仪器

为了一致地估计 \(\beta\),我们需要额外的信息。经济应用中常用的一类信息就是我们所说的工具。

定义 \(12.1\) \(\ell \times 1\) 随机向量 \(Z\) 是 (12.3) 的工具变量,如果

\[ \begin{aligned} \mathbb{E}[Z e] &=0 \\ \mathbb{E}\left[Z Z^{\prime}\right] &>0 \\ \operatorname{rank}\left(\mathbb{E}\left[Z X^{\prime}\right]\right) &=k . \end{aligned} \]

给出的定义包含三个组成部分。第一个 (12.5) 是工具与回归误差不相关。第二个 (12.6) 是排除线性冗余仪器的归一化。第三个 (12.7) 通常称为相关性条件,对于模型的识别至关重要,我们稍后将对此进行讨论。 (12.7) 的必要条件是 \(\ell \geq k\)。

条件 (12.5) - 工具与方程误差不相关 - 通常被描述为它们是外生的,因为它们是在 \(Y\) 模型之外确定的。

请注意,回归量 \(X_{1}\) 满足条件 (12.5),因此应作为工具变量包含在内。因此它们是变量 \(Z\) 的子集。符号上我们进行分区

\[ Z=\left(\begin{array}{l} Z_{1} \\ Z_{2} \end{array}\right)=\left(\begin{array}{c} X_{1} \\ Z_{2} \end{array}\right) \begin{aligned} &k_{1} \\ &\ell_{2} \end{aligned} . \]

这里,\(X_{1}=Z_{1}\) 是包含的外生变量,\(Z_{2}\) 是排除的外生变量。也就是说, \(Z_{2}\) 是可以包含在 \(Y\) 方程中的变量(从某种意义上说,它们与 \(e\) 不相关),但可以排除在外,因为它们在方程中具有真正的零系数。利用这个符号,我们还可以将结构方程(12.4)写为

\[ Y_{1}=Z_{1}^{\prime} \beta_{1}+Y_{2}^{\prime} \beta_{2}+e . \]

这是有用的符号,因为它阐明了变量 \(Z_{1}\) 是外生的,而变量 \(Y_{2}\) 是内生的。

许多作者将 \(Z_{1}\) 描述为“外生变量”,将 \(Y_{2}\) 描述为“内生变量”,将 \(Z_{2}\) 描述为“工具变量”。

如果 \(\ell=k\),我们说模型是刚刚识别的;如果 \(\ell>k\),我们说模型是过度识别的。

哪些变量可以用作工具变量?根据定义 \(\mathbb{E}[Z e]=0\),该工具必须与方程误差不相关,这意味着它被排除在上述结构方程之外。根据等级条件 (12.7),在控制其他外生变量 \(Z_{1}\) 后,工具变量与内生变量 \(Y_{2}\) 相关也很重要。这两个要求通常被解释为要求在系统外部确定 \(\vec{Y}\) 的工具,因果地确定 \(Y_{2}\),但不因果地确定 \(Y_{1}\),除非通过 \(Y_{2}\)。

我们以上面给出的三个例子为例。

回归器中的测量误差。当 \(X\) 是 \(Z\) 的错误测量版本时,工具 \(Z_{2}\) 的常见选择是 \(Z\) 的替代测量。为了使 \(Z_{2}\) 满足工具变量的属性,\(Z_{2}\) 中的测量误差必须独立于 \(X\) 中的测量误差。

供需。需求方程中价格 \(P\) 的合适工具是变量 \(Z_{2}\),它影响供给但不影响需求。这样的变量影响 \(P\) 和 \(Q\) 的均衡值,但除了通过数量之外,不会直接影响价格。影响供给但不影响需求的变量通常与生产成本有关。

供给方程中合适的价格工具是影响需求但不影响供给的变量。这种变量影响价格和数量的均衡值,但仅通过数量影响价格。

选择变量作为回归量。理想工具会影响回归量(教育)的选择,但不会直接影响因变量(工资),除非通过对回归量的间接影响。我们将在下一节中讨论一个例子。

12.6 示例:大学邻近度

David Card(1995)在一篇有影响力的论文中提出,如果潜在学生住在大学附近,就可以降低就读成本,从而提高学生上大学的可能性。然而,大学邻近性不会直接影响学生的技能或能力,因此不应对其市场工资产生直接影响。这些考虑因素表明,大学邻近性可以作为工资回归教育的工具。我们使用卡德论文中报告的最简单的模型来说明本章中工具变量的概念。

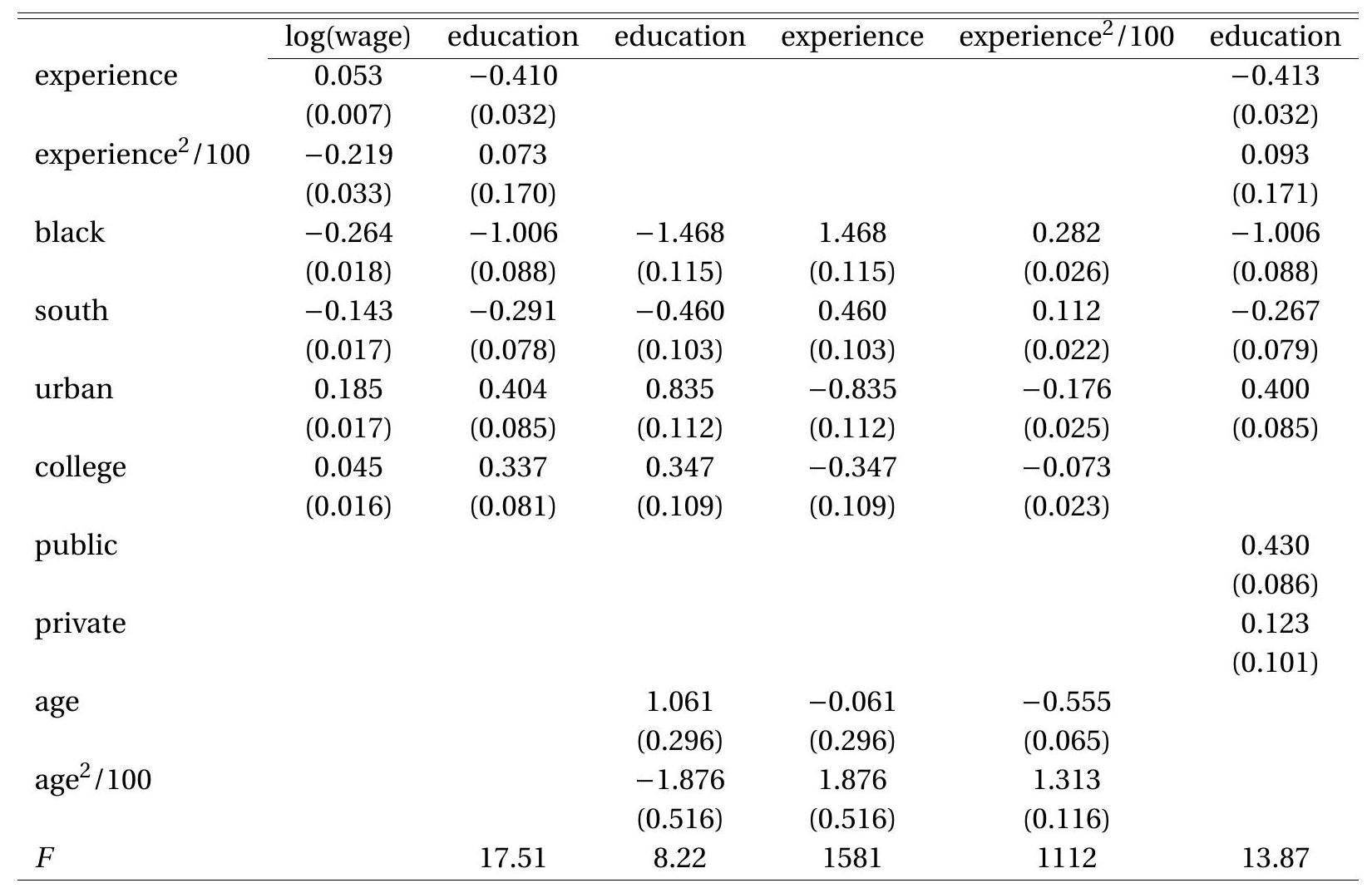

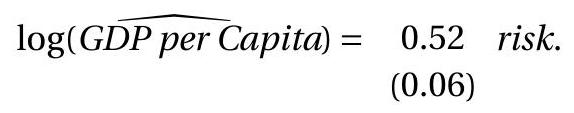

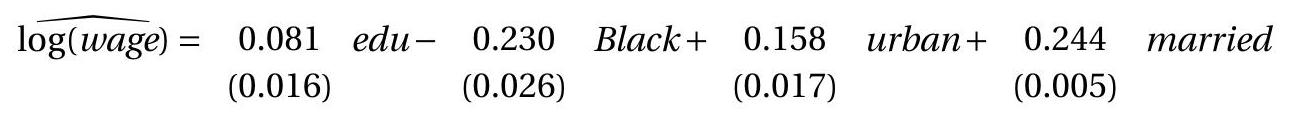

卡德使用了 1976 年全国青年纵向调查 (NLSYM) 的数据。表 12.1 的第一列报告了他的数据集的基线最小二乘工资回归。因变量是每周收入的对数。回归变量是教育(受教育年限)、经验(工作经验年数,计算方式为年龄(年)减去教育 \(+6\) )、经验 \({ }^{2} / 100\)、黑人、南方(居住在美国南部地区的指标) )和城市(居住在标准大都市统计区域的指标)。我们删除缺少工资的观察结果。其余样本有 3,010 个观测值。他的数据是课本网站上的文件Card1995。最小二乘法获得的点估计表明,每年教育年收入增加 \(7 %\)。

表 12.1:工具变量工资回归

| education | OLS | IV(a) | IV(b) | 2SLS(a) | 2SLS(b) | LIML |

|---|---|---|---|---|---|---|

| \(0.074\) | \(0.132\) | \(0.133\) | \(0.161\) | \(0.160\) | \(0.164\) | |

| \((0.004)\) | \((0.049)\) | \((0.051)\) | \((0.040)\) | \((0.041)\) | \((0.042)\) | |

| \(0.084\) | \(0.107\) | \(0.056\) | \(0.119\) | \(0.047\) | \(0.120\) | |

| experience \(2 / 100\) | \(-0.224\) | \(-0.228\) | \(-0.080\) | \(-0.231\) | \(-0.032\) | \(-0.231\) |

| \((0.032)\) | \((0.035)\) | \((0.133)\) | \((0.037)\) | \((0.127)\) | \((0.037)\) | |

| Black | \(-0.190\) | \(-0.131\) | \(-0.103\) | \(-0.102\) | \(-0.064\) | \(-0.099\) |

| \((0.017)\) | \((0.051)\) | \((0.075)\) | \((0.044)\) | \((0.061)\) | \((0.045)\) | |

| south | \(-0.125\) | \(-0.105\) | \(-0.098\) | \(-0.095\) | \(-0.086\) | \(-0.094\) |

| \((0.015)\) | \((0.023)\) | \((0.0284)\) | \((0.022)\) | \((0.026)\) | \((0.022)\) | |

| urban | \(0.161\) | \(0.131\) | \(0.108\) | \(0.116\) | \(0.083\) | \(0.115\) |

| \((0.015)\) | \((0.030)\) | \((0.049)\) | \((0.026)\) | \((0.041)\) | \((0.027)\) | |

| Sargan | \(0.82\) | \(0.52\) | \(0.82\) | |||

| p-value | \(0.37\) | \(0.47\) | \(0.37\) |

笔记:

IV(a) 使用大学作为教育工具。

IV(b) 使用大学、年龄和年龄 \(^{2} / 100\) 作为教育、经验和经验 \({ }^{2} / 100\) 的工具。

2SLS(a) 使用公共和私人作为教育工具。

\(2 \mathrm{SLS}(\mathrm{b})\) 使用公共、私人、年龄和年龄 \({ }^{2}\) 作为教育、经验和经验 \(^{2} / 100\) 的工具。

LIML 使用公共和私人作为教育工具。

正如前面几节所讨论的,将受教育年限视为个人做出的选择是合理的,因此教育的结构性回报可能是内生的。这意味着最小二乘是线性投影的估计,但与代表教育年限对预期工资因果影响的结构方程的系数不一致。劳动经济学预测,能力、教育和工资将呈正相关。这表明由最小二乘法估计的人口预测系数将高于结构参数(因此存在向上偏差)。然而,偏差的符号是不确定的,因为存在多个回归变量并且存在其他潜在的内生性来源。

为了衡量教育的内生性,卡德建议合理的工具是一个虚拟变量,表明个人是否在大学附近长大。我们将考虑三项措施:

大学 在同一县长大,读四年制大学

公立 在同一县长大,就读 4 年制公立大学

私立 在同一县长大,就读四年制私立大学。

12.7 简化形式

简化形式是内生回归变量 \(Y_{2}\) 和工具 \(Z\) 之间的关系。 \(Y_{2}\) 的线性简化形式模型是

\[ Y_{2}=\Gamma^{\prime} Z+u_{2}=\Gamma_{12}^{\prime} Z_{1}+\Gamma_{22}^{\prime} Z_{2}+u_{2} \]

这是第 11 章中介绍的多元回归。 \(\ell \times k_{2}\) 系数矩阵 \(\Gamma\) 通过线性投影定义:

\[ \Gamma=\mathbb{E}\left[Z Z^{\prime}\right]^{-1} \mathbb{E}\left[Z Y_{2}^{\prime}\right] \]

这意味着\(\mathbb{E}\left[Z u_{2}^{\prime}\right]=0\)。投影系数 (12.11) 在 (12.6) 下定义明确且唯一。

我们还构建了 \(Y_{1}\) 的简化形式。将(12.10)代入(12.9)可得

\[ \begin{aligned} Y_{1} &=Z_{1}^{\prime} \beta_{1}+\left(\Gamma_{12}^{\prime} Z_{1}+\Gamma_{22}^{\prime} Z_{2}+u_{2}\right)^{\prime} \beta_{2}+e \\ &=Z_{1}^{\prime} \lambda_{1}+Z_{2}^{\prime} \lambda_{2}+u_{1} \\ &=Z^{\prime} \lambda+u_{1} \end{aligned} \]

在哪里

\[ \begin{aligned} &\lambda_{1}=\beta_{1}+\Gamma_{12} \beta_{2} \\ &\lambda_{2}=\Gamma_{22} \beta_{2} \\ &u_{1}=u_{2}^{\prime} \beta_{2}+e . \end{aligned} \]

我们也可以写

\[ \lambda=\bar{\Gamma} \beta \]

在哪里

\[ \bar{\Gamma}=\left[\begin{array}{cc} \boldsymbol{I}_{k_{1}} & \Gamma_{12} \\ 0 & \Gamma_{22} \end{array}\right]=\left[\begin{array}{cc} \boldsymbol{I}_{k_{1}} & \Gamma \\ 0 & \end{array}\right] . \]

总而言之,系统的简化形式方程为

\[ \begin{aligned} &Y_{1}=\lambda^{\prime} Z+u_{1} \\ &Y_{2}=\Gamma^{\prime} Z+u_{2} . \end{aligned} \]

或者

\[ \vec{Y}=\left[\begin{array}{cc} \lambda_{1}^{\prime} & \lambda_{2}^{\prime} \\ \Gamma_{12}^{\prime} & \Gamma_{22}^{\prime} \end{array}\right] Z+u \]

其中 \(u=\left(u_{1}, u_{2}\right)\).

关系 (12.14)-(12.16) 对于理解结构参数 \(\beta_{1}\) 和 \(\beta_{2}\) 的识别至关重要,正如我们下面讨论的。这些方程显示了结构参数 \(\left(\beta_{1}\right.\) 和 \(\left.\beta_{2}\right)\) 与简化形式参数 \((\Gamma\) 和 \(\lambda)\) 之间的紧密关系。

简化形式的方程是投影,因此可以通过最小二乘法来估计系数(参见第 11 章)。 (12.11) 和 (12.13) 的最小二乘估计量为

\[ \begin{aligned} &\widehat{\Gamma}=\left(\sum_{i=1}^{n} Z_{i} Z_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} Z_{i} Y_{2 i}^{\prime}\right) \\ &\widehat{\lambda}=\left(\sum_{i=1}^{n} Z_{i} Z_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} Z_{i} Y_{1 i}\right) . \end{aligned} \]

12.8 鉴别

如果参数是可观测量概率分布的唯一函数,则该参数被识别。表明参数已被识别的一种方法是将其写为总体矩的显式函数。例如,简化形式系数矩阵 \(\Gamma\) 和 \(\lambda\) 被识别,因为它们可以写成变量 \((Y, X, Z)\) 矩的显式函数。那是,

\[ \begin{aligned} &\Gamma=\mathbb{E}\left[Z Z^{\prime}\right]^{-1} \mathbb{E}\left[Z Y_{2}^{\prime}\right] \\ &\lambda=\mathbb{E}\left[Z Z^{\prime}\right]^{-1} \mathbb{E}\left[Z Y_{1}\right] . \end{aligned} \]

如果定义 \(12.1\) 成立,则这些由 \(\left(Y_{1}, Y_{2}, Z\right)\) 的概率分布唯一确定,因为这包括 \(\mathbb{E}\left[Z Z^{\prime}\right]\) 可逆的要求。

我们对结构参数 \(\beta\) 感兴趣。它通过 (12.16) 与 \((\lambda, \Gamma)\) 相关。如果 \(\beta\) 由该关系唯一确定,则该 \(\beta\) 被识别。这是一组 \(\ell\) 方程,其中 \(k\) 未知数与 \(\ell \geq k\)。从线性代数我们知道,当且仅当 \(\bar{\Gamma}\) 具有满秩 \(k\) 时,存在唯一解。

\[ \operatorname{rank}(\bar{\Gamma})=k . \]

在 (12.22) 下 \(\beta\) 可以从 (12.16) 唯一求解。如果 (12.22) 失败,则 (12.16) 的方程数少于系数,因此不存在唯一解。

我们可以写\(\bar{\Gamma}=\mathbb{E}\left[Z Z^{\prime}\right]^{-1} \mathbb{E}\left[Z X^{\prime}\right]\)。将其与 (12.16) 结合我们得到

\[ \mathbb{E}\left[Z Z^{\prime}\right]^{-1} \mathbb{E}\left[Z Y_{1}\right]=\mathbb{E}\left[Z Z^{\prime}\right]^{-1} \mathbb{E}\left[Z X^{\prime}\right] \beta \]

或者

\[ \mathbb{E}\left[Z Y_{1}\right]=\mathbb{E}\left[Z X^{\prime}\right] \beta \]

这是一组带有 \(k\) 未知数的 \(\ell\) 方程。这有一个唯一的解决方案当(且仅当)

\[ \operatorname{rank}\left(\mathbb{E}\left[Z X^{\prime}\right]\right)=k \]

作为定义 12.1 的条件列在 (12.7) 中。 (事实上,这就是为什么它被列为定义的一部分。)我们还可以看到,(12.22)和(12.23)是表达相同要求的等效方式。如果此条件失败,则 \(\beta\) 将不会被识别。条件(12.22)-(12.23)称为相关性条件。

为解决方案 \(\beta\) 提供显式表达式非常有用。最简单的情况是当 \(\ell=k\) 时。那么 (12.22) 意味着 \(\bar{\Gamma}\) 是可逆的,因此结构参数等于 \(\beta=\bar{\Gamma}^{-1} \lambda\)。这是一个独特的解决方案,因为 \(\bar{\Gamma}\) 和 \(\lambda\) 是唯一的,而 \(\bar{\Gamma}\) 是可逆的。

当 \(\ell>k\) 时,我们可以通过对方程组 \(\lambda=\bar{\Gamma} \beta\) 应用最小二乘法来求解 \(\beta\)。这是带有 \(k\) 未知数且没有错误的 \(\ell\) 方程。最小二乘解是 \(\beta=\left(\bar{\Gamma}^{\prime} \bar{\Gamma}\right)^{-1} \bar{\Gamma}^{\prime} \lambda\)。在 (12.22) 下,矩阵 \(\bar{\Gamma}^{\prime} \bar{\Gamma}\) 是可逆的,因此解是唯一的。

如果 \(\operatorname{rank}(\bar{\Gamma})=k\) 则可识别 \(\beta\),当且仅当 \(\operatorname{rank}\left(\Gamma_{22}\right)=k_{2}\) 为真(通过 \(\bar{\Gamma})\) 的上对角线结构)。因此,识别模型的关键在于 \(\ell_{2} \times k_{2}\) 矩阵 \(\Gamma_{22}\) (12.10) 中。要看到这一点,请回忆一下简化形式的关系 (12.14)-(12.15)。我们可以看到 \(\beta_{2}\) 是从 (12.15) 单独确定的,并且充分必要条件是 \(\operatorname{rank}\left(\Gamma_{22}\right)=k_{2}\)。如果满足则解等于 \(\beta_{2}=\left(\Gamma_{22}^{\prime} \Gamma_{22}\right)^{-1} \Gamma_{22}^{\prime} \lambda_{2} \cdot \beta_{1}\) 从此和 (12.14) 中确定,并具有显式解 \(\beta\)。在刚刚确定的情况 \(\beta\) 中,这些方程简化为 \(\beta\) 和 \(\beta\)

12.9 工具变量估计器

在本节中,我们考虑模型刚刚被识别以便 \(\ell=k\) 的特殊情况。

\(Z\) 是工具变量的假设意味着 \(\mathbb{E}[Z e]=0\)。替换 \(e=Y_{1}-X^{\prime} \beta\) 我们找到 \(\mathbb{E}\left[Z\left(Y_{1}-X^{\prime} \beta\right)\right]=0\)。扩大,

\[ \mathbb{E}\left[Z Y_{1}\right]-\mathbb{E}\left[Z X^{\prime}\right] \beta=0 . \]

这是一个由 \(\ell=k\) 方程和 \(k\) 未知数组成的系统。求解 \(\beta\) 我们发现

\[ \beta=\left(\mathbb{E}\left[Z X^{\prime}\right]\right)^{-1} \mathbb{E}\left[Z Y_{1}\right] . \]

这要求矩阵 \(\mathbb{E}\left[Z X^{\prime}\right]\) 是可逆的,它在 (12.7) 或等效的 (12.23) 下成立。

工具变量 (IV) 估计器 \(\beta\) 用样本矩代替总体。我们发现

\[ \begin{aligned} \widehat{\beta}_{\mathrm{iv}} &=\left(\frac{1}{n} \sum_{i=1}^{n} Z_{i} X_{i}^{\prime}\right)^{-1}\left(\frac{1}{n} \sum_{i=1}^{n} Z_{i} Y_{1 i}\right) \\ &=\left(\sum_{i=1}^{n} Z_{i} X_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} Z_{i} Y_{1 i}\right) . \end{aligned} \]

更一般地说,给定任何变量 \(W \in \mathbb{R}^{k}\),通常会引用估计器

\[ \widehat{\beta}_{\mathrm{iv}}=\left(\sum_{i=1}^{n} W_{i} X_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} W_{i} Y_{1 i}\right) \]

作为使用工具 \(W\) 的 \(\beta\) 的 IV 估计器。

或者,回想一下,当 \(\ell=k\) 时,结构参数可以写为简化形式参数的函数 \(\beta=\bar{\Gamma}^{-1} \lambda\)。将 \(\bar{\Gamma}\) 和 \(\lambda\) 替换为它们的最小二乘估计器 (12.18)-(12.19),我们可以构造所谓的间接最小二乘 (ILS) 估计器。使用矩阵代数表示

\[ \begin{aligned} \widehat{\beta}_{\mathrm{ils}} &=\widehat{\bar{\Gamma}}^{-1} \widehat{\lambda} \\ &=\left(\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)\right)^{-1}\left(\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}\right)\right) \\ &=\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}\right) \\ &=\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}\right) . \end{aligned} \]

我们看到这等于 IV 估计量 (12.24)。因此 ILS 和 IV 估计器是相同的。

给定 IV 估计器,我们定义残差 \(\widehat{e}_{i}=Y_{1 i}-X_{i}^{\prime} \widehat{\beta}_{\mathrm{iv}}\)。它满足

\[ \boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}}=\boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}-\boldsymbol{Z}^{\prime} \boldsymbol{X}\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}\right)=0 \]

由于 \(Z\) 包含截距,这意味着残差总和为零,并且与包含和排除的工具不相关。

为了说明 IV 回归,我们估计了简化形式的方程,将教育视为内生的,并使用大学作为工具变量。表 12.2 的第一列和第二列报告了 log(工资)和教育程度的简化形式方程。表 12.2:简化形式回归

特别令人感兴趣的是内生回归教育的方程,以及排除工具(在本例中为大学)的系数。估计系数等于 \(0.337\),但标准误差较小。这意味着在四年制大学附近长大会使平均受教育程度提高 \(0.3\) 年。这似乎是一个合理的幅度。

由于结构方程是用一个右侧内生变量来识别的,因此教育系数的 ILS/IV 估计值是两个方程中仪器学院系数估计值的比率,例如\(0.045 / 0.337=0.13\),意味着每年的教育回报为\(13 %\)。这远远大于表 12.1 第一列的 \(7 %\) 最小二乘估计值。完整方程的 IV 估计值报告在表 12.1 的第二列中。第一反应是惊讶 IV 估计值大于 OLS 估计值。教育选择的内生性应该会导致 OLS 估计量出现向上偏差,这预测 IV 估计量应该小于 OLS 估计量。可能需要另一种解释。一种可能性是异质教育效应(当教育系数 \(\beta\) 在个体之间异质时)。在 \(12.34\) 节中,我们表明,在这种情况下,IV 估计器会针对人口子集获取这种治疗效果,这可以解释为什么 IV 估计会产生更大的估计系数。

卡德(1995)还指出,如果教育是内生的,那么我们对经验的衡量也是内生的,因为它是通过年龄减去教育程度来计算的。他建议我们可以使用变量age和age \({ }^{2}\)作为经验和经验\({ }^{2}\)的工具。年龄变量是外生的(不是选择变量),但与经验和经验 \({ }^{2}\) 高度相关。请注意,这种方法将经验 \({ }^{2}\) 视为与经验分开的变量。确实,这才是正确的做法。

根据这一建议,我们现在有了三个内生回归量和三个工具。我们在表 12.2 的第三到第五列中提出了三个内生回归量的三个简化形式方程。比较教育和经验的方程式很有趣。除了年龄系数外,这两组系数只是另一组系数的符号变化。事实上,情况一定如此,因为这三个变量是线性相关的。这会给 2SLS 带来问题吗?幸运的是,没有。事实上,年龄系数不仅仅是符号变化,这意味着方程不是线性奇异的。因此不违反假设(12.22)。

使用大学、年龄和年龄 \({ }^{2}\) 这三个工具对内生回归变量教育、经验和经验 \({ }^{2}\) 进行的 IV 估计显示在表 12.1 的第三列中。学校教育回报的估计不受工具集变化的影响,但经验回报的估计曲线趋于平缓(二次效应减弱)。

IV 估计量可以在 Stata 中使用 ivregress 2 sls 命令计算。

12.10 贬低代表

众所周知的线性回归贬义表示(3.18)是否也适用于 IV 估计器?要查看,请以 \(Y_{1}=X^{\prime} \beta+\alpha+e\) 格式编写线性投影方程,其中 \(\alpha\) 是截距,\(X\) 不包含常量。同样,将工具分区为 \((1, Z)\),其中 \(Z\) 不包含常量。我们可以将 \(i^{t h}\) 方程的 IV 估计量写为

\[ Y_{1 i}=X_{i}^{\prime} \widehat{\beta}_{\mathrm{iv}}+\widehat{\alpha}_{\mathrm{iv}}+\widehat{e}_{i} . \]

正交性 (12.25) 意味着二元方程组

\[ \begin{aligned} &\sum_{i=1}^{n}\left(Y_{1 i}-X_{i}^{\prime} \widehat{\beta}_{\mathrm{iv}}-\widehat{\alpha}_{\mathrm{iv}}\right)=0 \\ &\sum_{i=1}^{n} Z_{i}\left(Y_{1 i}-X_{i}^{\prime} \widehat{\beta}_{\mathrm{iv}}-\widehat{\alpha}_{\mathrm{iv}}\right)=0 . \end{aligned} \]

第一个方程意味着 \(\widehat{\alpha}_{\mathrm{iv}}=\overline{Y_{1}}-\bar{X}^{\prime} \widehat{\beta}_{\mathrm{iv}}\)。代入第二个方程

\[ \sum_{i=1}^{n} Z_{i}\left(\left(Y_{1 i}-\overline{Y_{1}}\right)-\left(X_{i}-\bar{X}\right)^{\prime} \widehat{\beta}_{\mathrm{iv}}\right) \]

并求解 \(\widehat{\beta}_{\text {iv }}\) 我们发现

\[ \begin{aligned} \widehat{\beta}_{\mathrm{iv}} &=\left(\sum_{i=1}^{n} Z_{i}\left(X_{i}-\bar{X}\right)^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} Z_{i}\left(Y_{1 i}-\bar{Y}_{1}\right)\right) \\ &=\left(\sum_{i=1}^{n}\left(Z_{i}-\bar{Z}\right)\left(X_{i}-\bar{X}\right)^{\prime}\right)^{-1}\left(\sum_{i=1}^{n}\left(Z_{i}-\bar{Z}\right)\left(Y_{1 i}-\bar{Y}_{1}\right)\right) . \end{aligned} \]

因此,最小二乘的贬义方程会延续到 IV 估计器。系数估计器 \(\widehat{\beta}_{\text {iv }}\) 仅是贬低数据的函数。

12.11 瓦尔德估计器

在许多情况下,包括卡邻近示例,排除的工具是二进制(虚拟)变量。让我们关注这种情况,并假设模型只有一个内生回归量,并且截距之外没有其他回归量。该模型可以写为 \(Y=X \beta+\alpha+e\) 与 \(\mathbb{E}[e \mid Z]=0\) 和 \(Z\) 二进制。分别给出 \(Z=1\) 和 \(Z=0\) 的结构方程的期望。我们获得

\[ \begin{aligned} &\mathbb{E}[Y \mid Z=1]=\mathbb{E}[X \mid Z=1] \beta+\alpha \\ &\mathbb{E}[Y \mid Z=0]=\mathbb{E}[X \mid Z=0] \beta+\alpha . \end{aligned} \]

减去并除以得到斜率系数的表达式

\[ \beta=\frac{\mathbb{E}[Y \mid Z=1]-\mathbb{E}[Y \mid Z=0]}{\mathbb{E}[X \mid Z=1]-\mathbb{E}[X \mid Z=0]} . \]

自然矩估计器用“分组数据”内的平均值替换期望值,其中分别为 \(Z_{i}=1\) 和 \(Z_{i}=0\)。也就是说,定义组意味着

\[ \begin{array}{ll} \bar{Y}_{1}=\frac{\sum_{i=1}^{n} Z_{i} Y_{i}}{\sum_{i=1}^{n} Z_{i}}, & \bar{Y}_{0}=\frac{\sum_{i=1}^{n}\left(1-Z_{i}\right) Y_{i}}{\sum_{i=1}^{n}\left(1-Z_{i}\right)} \\ \bar{X}_{1}=\frac{\sum_{i=1}^{n} Z_{i} X_{i}}{\sum_{i=1}^{n} Z_{i}}, & \bar{X}_{0}=\frac{\sum_{i=1}^{n}\left(1-Z_{i}\right) X_{i}}{\sum_{i=1}^{n}\left(1-Z_{i}\right)} \end{array} \]

和矩估计器

\[ \widehat{\beta}=\frac{\bar{Y}_{1}-\bar{Y}_{0}}{\bar{X}_{1}-\bar{X}_{0}} . \]

这就是 Wald (1940) 的“Wald 估计器”。

这些表述都颇有见地。 (12.27)表明,结构斜率系数是由于改变工具而导致的 \(Y\) 的预期变化除以由于改变工具而导致的 \(X\) 的预期变化。非正式地,它是 \(Y\) 的变化(由于 \(Z\) )相对于 \(X\) 的变化(由于 \(Z\) )。方程(12.28)表明斜率系数可以通过均值差之比来估计。

表达式 (12.28) 可能看起来像是与 IV 估计器 \(\widehat{\beta}_{\text {iv }}\) 不同的估计器,但事实证明它们是相同的。即 \(\widehat{\beta}=\widehat{\beta}_{\mathrm{iv}}\)。要看到这一点,请使用 (12.26) 来查找

\[ \widehat{\beta}_{\mathrm{iv}}=\frac{\sum_{i=1}^{n} Z_{i}\left(Y_{i}-\bar{Y}\right)}{\sum_{i=1}^{n} Z_{i}\left(X_{i}-\bar{X}\right)}=\frac{\bar{Y}_{1}-\bar{Y}}{\bar{X}_{1}-\bar{X}} . \]

然后注意

\[ \bar{Y}_{1}-\bar{Y}=\bar{Y}_{1}-\left(\frac{1}{n} \sum_{i=1}^{n} Z_{i} \bar{Y}_{1}+\frac{1}{n} \sum_{i=1}^{n}\left(1-Z_{i}\right) \bar{Y}_{0}\right)=(1-\bar{Z})\left(\bar{Y}_{1}-\bar{Y}_{0}\right) \]

和类似地

\[ \bar{X}_{1}-\bar{X}=(1-\bar{Z})\left(\bar{X}_{1}-\bar{X}_{0}\right) \]

因此

\[ \widehat{\beta}_{\mathrm{iv}}=\frac{(1-\bar{Z})\left(\bar{Y}_{1}-\bar{Y}_{0}\right)}{(1-\bar{Z})\left(\bar{X}_{1}-\bar{X}_{0}\right)}=\widehat{\beta} \]

如(12.28)中所定义。因此 Wald 估计量等于 IV 估计量。

我们可以使用卡邻近示例进行说明。如果我们估计一个没有协变量的简单 IV 模型,我们将获得估计值 \(\widehat{\beta}_{\text {iv }}=0.19\)。如果我们根据我们发现的仪器大学估计对数工资和教育的群体平均值

| near college | not near college | difference | |

|---|---|---|---|

| \(\log (\) wage) | \(6.311\) | \(6.156\) | \(0.155\) |

| education | \(13.527\) | \(12.698\) | \(0.829\) |

| ratio | \(0.19\) |

基于这些估计,斜率系数的 Wald 估计量为 \((6.311-6.156) /(13.527-12.698)=\) \(0.155 / 0.829=0.19\),与 IV 估计量相同。

12.12 两阶段最小二乘法

上一节中描述的 IV 估计器假定 \(\ell=k\)。现在我们允许 \(\ell \geq k\) 的一般情况。检查简化形式的方程(12.13)我们看到

\[ \begin{aligned} Y_{1} &=Z^{\prime} \bar{\Gamma} \beta+u_{1} \\ \mathbb{E}\left[Z u_{1}\right] &=0 . \end{aligned} \]

定义 \(W=\bar{\Gamma}^{\prime} Z\) 我们可以写成

\[ \begin{aligned} Y_{1} &=W^{\prime} \beta+u_{1} \\ \mathbb{E}\left[W u_{1}\right] &=0 . \end{aligned} \]

思考这个问题的一种方法是 \(Z\) 是一组候选工具。工具向量 \(W=\bar{\Gamma}^{\prime} Z\) 是 \(k\) 维线性组合的集合。

假设 \(\bar{\Gamma}\) 已知。然后我们将通过 \(W=\bar{\Gamma}^{\prime} Z\) 上的 \(Y_{1}\) 的最小二乘来估计 \(\beta\)

\[ \widehat{\beta}=\left(\boldsymbol{W}^{\prime} \boldsymbol{W}\right)^{-1}\left(\boldsymbol{W}^{\prime} \boldsymbol{Y}\right)=\left(\bar{\Gamma}^{\prime} \boldsymbol{Z}^{\prime} \boldsymbol{Z} \bar{\Gamma}\right)^{-1}\left(\bar{\Gamma}^{\prime} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}\right) . \]

虽然这是不可行的,但我们可以从简化形式的回归中估计 \(\bar{\Gamma}\)。将 \(\bar{\Gamma}\) 替换为其估计器 \(\widehat{\Gamma}=\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)\) 我们得到

\[ \begin{aligned} \widehat{\beta}_{2 \text { sls }} &=\left(\widehat{\Gamma}^{\prime} \boldsymbol{Z}^{\prime} \boldsymbol{Z} \widehat{\Gamma}\right)^{-1}\left(\widehat{\Gamma}^{\prime} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}\right) \\ &=\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-\mathbf{1}} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1} \\ &=\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1} \end{aligned} \]

这称为两阶段最小二乘 (2SLS) 估计器。它最初由 Theil (1953) 和 Basmann (1957) 提出,是仪器线性方程的标准估计器。

如果模型是刚刚识别的,那么\(k=\ell\),那么2SLS就简化为上一节的IV估计器。由于矩阵 \(\boldsymbol{X}^{\prime} \boldsymbol{Z}\) 和 \(\boldsymbol{Z}^{\prime} \boldsymbol{X}\) 是方阵,我们可以因式分解

\[ \begin{aligned} \left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} &=\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1}\left(\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\right)^{-1}\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\right)^{-1} \\ &=\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\right)^{-1} \end{aligned} \]

(再一次,这仅在 \(k=\ell\) 时有效。)然后

\[ \begin{aligned} \widehat{\beta}_{2 \text { sls }} &=\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1} \\ &=\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1} \\ &=\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1} \\ &=\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}=\widehat{\beta}_{\mathrm{iv}} \end{aligned} \]

正如所声称的那样。这表明(12.29)中定义的 2SLS 估计器是(12.24)中定义的 IV 估计器的推广。

我们现在描述的 2SLS 估计器有几种替代表示形式。一、定义投影矩阵

\[ \boldsymbol{P}_{\boldsymbol{Z}}=\boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \]

我们可以将 2SLS 估计器写得更紧凑:

\[ \widehat{\beta}_{2 \text { sls }}=\left(\boldsymbol{X}^{\prime} \boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{Y}_{1} . \]

这对于表示和推导很有用,但对于计算没有用,因为当 \(n\) 很大时,\(n \times n\) 矩阵 \(\boldsymbol{P}_{\boldsymbol{Z}}\) 太大而无法计算。

其次,根据简化形式 \(\widehat{\boldsymbol{X}}=\boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{X}=\boldsymbol{Z} \widehat{\Gamma}\) 定义 \(\boldsymbol{X}\) 的拟合值。那么2SLS估计器可以写为

\[ \widehat{\beta}_{2 \text { sls }}=\left(\widehat{\boldsymbol{X}}^{\prime} \boldsymbol{X}\right)^{-1} \widehat{\boldsymbol{X}}^{\prime} \boldsymbol{Y}_{1} \]

这是上一节中定义的 IV 估计器,使用 \(\widehat{X}\) 作为 \(X\) 的工具。

第三,因为 \(\boldsymbol{P}_{Z}\) 是幂等的,我们也可以将 2SLS 估计器写为

\[ \widehat{\beta}_{2 \text { sls }}=\left(\boldsymbol{X}^{\prime} \boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{Y}_{1}=\left(\widehat{\boldsymbol{X}}^{\prime} \widehat{\boldsymbol{X}}\right)^{-1} \widehat{\boldsymbol{X}}^{\prime} \boldsymbol{Y}_{1} \]

这是通过对拟合值 \(\widehat{X}\) 进行回归 \(Y_{1}\) 获得的最小二乘估计量。

这是“两阶段”名称的来源,因为它可以按如下方式计算。

在 \(Z\) 上回归 \(X\) 以获得拟合的 \(\widehat{X}: \widehat{\Gamma}=\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)\) 和 \(\widehat{\boldsymbol{X}}=\boldsymbol{Z} \widehat{\Gamma}=\boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{X}\)。

在 \(\widehat{X}: \widehat{\beta}_{2 s l s}=\left(\widehat{\boldsymbol{X}}^{\prime} \widehat{\boldsymbol{X}}\right)^{-1} \widehat{\boldsymbol{X}}^{\prime} \boldsymbol{Y}_{1}\) 上回归 \(Y_{1}\)

仔细检查投影 \(\widehat{\boldsymbol{X}}\) 很有用。回想一下,\(\boldsymbol{X}=\left[\boldsymbol{Z}_{1}, \boldsymbol{Y}_{2}\right]\) 和 \(\boldsymbol{Z}=\left[\boldsymbol{Z}_{1}, \boldsymbol{Z}_{2}\right]\)。注意 \(\widehat{\boldsymbol{X}}_{1}=\boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{Z}_{1}=\) \(Z_{1}\) 因为 \(Z_{1}\) 位于 \(\boldsymbol{Z}\) 的范围内。然后是\(\widehat{\boldsymbol{X}}=\left[\widehat{\boldsymbol{X}}_{1}, \widehat{\boldsymbol{Y}}_{2}\right]=\left[\boldsymbol{Z}_{1}, \widehat{\boldsymbol{Y}}_{2}\right]\)。这表明在第二阶段我们在 \(\widehat{\boldsymbol{X}}\) 和 \(\widehat{\boldsymbol{X}}\) 上回归 \(Y_{1}\)。这意味着只有内生变量 \(\widehat{\boldsymbol{X}}\) 被其拟合值 \(\widehat{\boldsymbol{X}}\) 替换。

2SLS 的第四种表示可以使用 FWL 定理获得。第三种表示和随后的讨论表明,2SLS 是作为 \(Y_{1}\) 对拟合值 \(\left(Z_{1}, \widehat{Y}_{2}\right)\) 的最小二乘而获得的。因此,内生变量的系数 \(\widehat{\beta}_{2}\) 可以通过残差回归找到。设置 \(\boldsymbol{P}_{1}=\) \(Z_{1}\left(Z_{1}^{\prime} Z_{1}\right)^{-1} Z_{1}^{\prime}\)。应用 FWL 定理我们得到

\[ \begin{aligned} \widehat{\beta}_{2} &=\left(\widehat{\boldsymbol{Y}}_{2}^{\prime}\left(\boldsymbol{I}_{n}-\boldsymbol{P}_{1}\right) \widehat{\boldsymbol{Y}}_{2}\right)^{-1}\left(\widehat{\boldsymbol{Y}}_{2}^{\prime}\left(\boldsymbol{I}_{n}-\boldsymbol{P}_{1}\right) \boldsymbol{Y}_{1}\right) \\ &=\left(\boldsymbol{Y}_{2}^{\prime} \boldsymbol{P}_{\boldsymbol{Z}}\left(\boldsymbol{I}_{n}-\boldsymbol{P}_{1}\right) \boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{Y}_{2}\right)^{-1}\left(\boldsymbol{Y}_{2}^{\prime} \boldsymbol{P}_{\boldsymbol{Z}}\left(\boldsymbol{I}_{n}-\boldsymbol{P}_{1}\right) \boldsymbol{Y}_{1}\right) \\ &=\left(\boldsymbol{Y}_{2}^{\prime}\left(\boldsymbol{P}_{\boldsymbol{Z}}-\boldsymbol{P}_{1}\right) \boldsymbol{Y}_{2}\right)^{-1}\left(\boldsymbol{Y}_{2}^{\prime}\left(\boldsymbol{P}_{\boldsymbol{Z}}-\boldsymbol{P}_{1}\right) \boldsymbol{Y}_{1}\right) \end{aligned} \]

因为\(\boldsymbol{P}_{Z} \boldsymbol{P}_{1}=\boldsymbol{P}_{1}\)。

第五表示可以通过进一步的投影来获得。投影矩阵 \(\boldsymbol{P}_{\boldsymbol{Z}}\) 可以替换为对 \(\left[\boldsymbol{Z}_{1}, \widetilde{\boldsymbol{Z}}_{2}\right.\) ] 上的投影,其中 \(\widetilde{\boldsymbol{Z}}_{2}=\left(\boldsymbol{I}_{n}-\boldsymbol{P}_{1}\right) \boldsymbol{Z}_{2}\) 是与 \(\boldsymbol{Z}_{1}\) 正交的 \(\boldsymbol{Z}_{2}\) 投影。由于 \(\boldsymbol{Z}_{1}\) 和 \(\widetilde{\boldsymbol{Z}}_{2}\) 是正交的,因此 \(\boldsymbol{P}_{\boldsymbol{Z}}=\boldsymbol{P}_{1}+\boldsymbol{P}_{2}\) 其中 \(\boldsymbol{P}_{2}=\widetilde{\boldsymbol{Z}}_{2}\left(\widetilde{\boldsymbol{Z}}_{2}^{\prime} \widetilde{\boldsymbol{Z}}_{2}\right)^{-1} \widetilde{\boldsymbol{Z}}_{2}^{\prime}\)。因此 \(\boldsymbol{P}_{\boldsymbol{Z}}\) 和

\[ \begin{aligned} \widehat{\beta}_{2} &=\left(\boldsymbol{Y}_{2}^{\prime} \boldsymbol{P}_{2} \boldsymbol{Y}_{2}\right)^{-1}\left(\boldsymbol{Y}_{2}^{\prime} \boldsymbol{P}_{2} \boldsymbol{Y}_{1}\right) \\ &=\left(\boldsymbol{Y}_{2}^{\prime} \widetilde{\boldsymbol{Z}}_{2}\left(\widetilde{\boldsymbol{Z}}_{2}^{\prime} \widetilde{\boldsymbol{Z}}_{2}\right)^{-1} \widetilde{\boldsymbol{Z}}_{2}^{\prime} \boldsymbol{Y}_{2}\right)^{-1}\left(\boldsymbol{Y}_{2}^{\prime} \widetilde{\boldsymbol{Z}}_{2}\left(\widetilde{\boldsymbol{Z}}_{2}^{\prime} \widetilde{\boldsymbol{Z}}_{2}\right)^{-1} \widetilde{\boldsymbol{Z}}_{2}^{\prime} \boldsymbol{Y}_{1}\right) . \end{aligned} \]

给定 2SLS 估计器,我们定义残差 \(\widehat{e}_{i}=Y_{1 i}-X_{i}^{\prime} \widehat{\beta}_{2 s l s}\)。当模型被过度识别时,工具和残差就不正交。即 \(\boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}} \neq 0\)。不过它确实满足

\[ \begin{aligned} \widehat{\boldsymbol{X}}^{\prime} \widehat{\boldsymbol{e}} &=\widehat{\boldsymbol{\Gamma}}^{\prime} \boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}} \\ &=\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}} \\ &=\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}-\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{X} \widehat{\beta}_{2 \text { sls }}=0 . \end{aligned} \]

回到卡德的大学邻近度例子,假设我们将经验视为外生的,但我们不使用单一工具大学(在四年制大学附近长大),而是使用两种工具(公立、私立)(在公立/私立大学附近长大)分别为四年制大学)。在这种情况下,我们有一个内生变量(教育)和两种工具(公共、私人)。表 12.2 第六列列出了教育的估计简化形式方程。在本规范中,公立大学(在公立四年制大学附近长大)的系数比之前规范中变量大学的系数稍大(第 2 列)。此外,在私立四年制大学附近成长的系数要小得多。这表明邻近性对教育的主要影响是通过公立大学而不是私立大学。

表 12.1 的第四列列出了使用这两种工具获得的 2SLS 估计值。教育系数增加到 \(0.161\),表明一年的教育回报为 \(16 %\)。这大约是第一列中通过最小二乘法获得的估计值的两倍。

此外,如果我们遵循 Card 并将经验视为内生并使用年龄作为工具,我们现在就有三个内生变量(教育、经验、经验 \({ }^{2} / 100\) )和四个工具(公共、私人、年龄、\(a g e^{2}\) )。我们在表 12.1 的第五列中展示了使用该规范的 2SLS 估计值。教育回报的估计值仍为 \(16 %\),而经验回报则趋于平缓。

您可能想知道我们是否可以使用所有三种工具——大学、公立和私立。答案是不。这是因为 College \(=\) public \(+\) private 所以这三个变量是共线的。由于这些工具是线性相关的,因此这三个工具一起将违反满秩条件(12.6)。

2SLS 估计量可以在 Stata 中使用 ivregress 2 sls 命令计算。

12.13 有限信息最大似然

估计结构方程参数的另一种方法是通过最大似然法。 Anderson 和 Rubin (1949) 推导出 \(\vec{Y}=\left(Y_{1}, Y_{2}\right)\) 联合分布的最大似然估计量。该估计量称为有限信息最大似然 (LIML)。

该估计器称为“有限信息”,因为它基于 \(Y\) 的结构方程与 \(X_{2}\) 的简化形式方程相结合。如果最大似然也是基于 \(X_{2}\) 的结构方程导出的,这将导致所谓的全信息最大似然 (FIML)。 LIML 相对于 FIML 的优势在于,前者不需要 \(X_{2}\) 的结构模型,因此允许研究人员专注于感兴趣的结构方程 - \(Y\) 的结构方程。我们不描述 FIML 估计量,因为它在应用计量经济学中并不常用。

虽然 LIML 估计量在经济学家中的使用不如 2SLS 广泛,但它已重新受到计量经济学理论家的关注。

要导出 LIML 估计器,请回忆定义 \(\vec{Y}=\left(Y_{1}, Y_{2}\right)\) 和简化形式 (12.17)

\[ \begin{aligned} \vec{Y} &=\left[\begin{array}{cc} \lambda_{1}^{\prime} & \lambda_{2} \\ \Gamma_{12}^{\prime} & \Gamma_{22}^{\prime} \end{array}\right]\left(\begin{array}{l} Z_{1} \\ Z_{2} \end{array}\right)+u \\ &=\Pi_{1}^{\prime} Z_{1}+\Pi_{2}^{\prime} Z_{2}+u \end{aligned} \]

其中 \(\Pi_{1}=\left[\begin{array}{cc}\lambda_{1} & \Gamma_{12}\end{array}\right]\) 和 \(\Pi_{2}=\left[\begin{array}{cc}\lambda_{2} & \Gamma_{22}\end{array}\right]\)。 LIML 估计量是在 \(u\) 为多元正态分布的假设下导出的。

定义\(\gamma^{\prime}=\left[\begin{array}{ll}1 & -\beta_{2}^{\prime}\end{array}\right]\)。从(12.15)我们发现

\[ \Pi_{2} \gamma=\lambda_{2}-\Gamma_{22} \beta_{2}=0 . \]

因此 (12.33) 中的 \(\ell_{2} \times\left(k_{2}+1\right)\) 系数矩阵 \(\Pi_{2}\) 的秩不足。事实上,它的排名必须是 \(k_{2}\) 因为 \(\Gamma_{22}\) 具有满排名。

这意味着模型 (12.33) 正是 \(11.11 .\) 节的降序回归模型。定理 \(11.7\) 给出了降序参数的最大似然估计量。特别是,\(\gamma\) 的 MLE 是

\[ \widehat{\gamma}=\underset{\gamma}{\operatorname{argmin}} \frac{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{1} \overrightarrow{\boldsymbol{Y}} \gamma}{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}} \overrightarrow{\boldsymbol{Y}} \gamma} \]

其中 \(\boldsymbol{M}_{1}=\boldsymbol{I}_{n}-\boldsymbol{Z}_{1}\left(\boldsymbol{Z}_{1}^{\prime} \boldsymbol{Z}_{1}\right)^{-1} \boldsymbol{Z}_{1}^{\prime}\) 和 \(\boldsymbol{M}_{\boldsymbol{Z}}=\boldsymbol{I}_{n}-\boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime}\)。最小化 (12.34) 有时称为“最小方差比”问题。

最小化问题 (12.34) 对于 \(\gamma\) 的规模是不变的(也就是说,\(\widehat{\gamma} c\) 相当于任何 c 的 argmin),因此需要标准化。一个方便的选择是 \(\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{Z} \overrightarrow{\boldsymbol{Y}} \gamma=1\)。使用这种归一化和最小二次形式理论(A.15 节),\(\widehat{\gamma}\) 是 \(\overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{1} \overrightarrow{\boldsymbol{Y}}\) 相对于与最小广义特征值相关的 \(\overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{Z} \overrightarrow{\boldsymbol{Y}}\) 的广义特征向量。 (有关广义特征值和特征向量的定义,请参阅第 A.14 节。)从计算角度来看,这很简单。例如,在 MATLAB 中,矩阵 \(\boldsymbol{A}\) 相对于 \(\boldsymbol{B}\) 的广义特征值和特征向量可通过命令 eig \((\boldsymbol{A}, \boldsymbol{B})\) 找到。一旦找到这个 \(\gamma\) ,就可以通过重新缩放来获得任何其他标准化。例如,要获取 \(\gamma\) 的 MLE,请对 \(\gamma\) 进行分区并设置 \(\gamma\)。

要获得 \(\beta_{1}\) 的 MLE,请回想一下结构方程 \(Y_{1}=Z_{1}^{\prime} \beta_{1}+Y_{2}^{\prime} \beta_{2}+e\)。将 \(\beta_{2}\) 替换为 MLE \(\widehat{\beta}_{2}\) 并应用回归。这产生

\[ \widehat{\beta}_{1}=\left(Z_{1}^{\prime} Z_{1}\right)^{-1} Z_{1}^{\prime}\left(Y_{1}-Y_{2} \widehat{\beta}_{2}\right) . \]

这些解是结构参数 \(\beta_{1}\) 和 \(\beta_{2}\) 的 MLE。

以前的计量经济学教科书没有提供 LIML 估计量的推导,因为 Anderson 和 Rubin (1949) 的原始推导很长而且不是特别有洞察力。相比之下,这里基于降序回归给出的推导很简单。

LIML 估计器有一个替代(和传统)表达式。定义 (12.34) 中获得的最小值

\[ \widehat{\boldsymbol{\kappa}}=\min _{\gamma} \frac{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{1} \overrightarrow{\boldsymbol{Y}} \gamma}{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}} \overrightarrow{\boldsymbol{Y}} \gamma} \]

这是 \(\overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{1} \overrightarrow{\boldsymbol{Y}}\) 相对于 \(\overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}} \overrightarrow{\boldsymbol{Y}}\) 的最小广义特征值。 LIML 估计器可以写为

\[ \widehat{\beta}_{\text {liml }}=\left(\boldsymbol{X}^{\prime}\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{X}\right)^{-1}\left(\boldsymbol{X}^{\prime}\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{Y}_{1}\right) . \]

我们将 (12.37) 的推导推迟到本节末尾。表达式 (12.37) 并没有简化计算(因为 \(\widehat{\kappa}\) 需要解决产生 \(\widehat{\beta}_{2}\) 的相同特征向量问题)。然而(12.37)对于分布理论很重要。它还有助于揭示 LIML、最小二乘法和 2SLS 之间的代数联系。

具有任意 \(\kappa\) 的估计器 (12.37) 被称为 \(\beta\) 的 k 类估计器。 LIML 估计器是通过设置 \(\kappa=\widehat{\kappa}\) 获得的,最小二乘估计器是通过设置 \(\kappa=0\) 获得的,2SLS 是通过设置 \(\kappa=1\) 获得的。值得注意的是,LIML 解决方案满足 \(\widehat{\kappa} \geq 1\)。当模型刚刚被识别时,LIML 估计器与 IV 和 2SLS 估计器相同。它们只是在过度识别的环境中有所不同。 (一个推论是,在正义识别和正常误差下,IV 估计量是 MLE。)

为了进行推理,观察 (12.37) 表明 \(\widehat{\beta}_{\mathrm{liml}}\) 可以写成 IV 估计器

\[ \widehat{\beta}_{\mathrm{liml}}=\left(\widetilde{\boldsymbol{X}}^{\prime} \boldsymbol{X}\right)^{-1}\left(\widetilde{\boldsymbol{X}}^{\prime} \boldsymbol{Y}_{1}\right) \]

使用仪器

\[ \widetilde{\boldsymbol{X}}=\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{X}=\left(\begin{array}{c} \boldsymbol{X}_{1} \\ \boldsymbol{X}_{2}-\widehat{\kappa} \widehat{\boldsymbol{U}}_{2} \end{array}\right) \]

其中 \(\widehat{\boldsymbol{U}}_{2}=\boldsymbol{M}_{\boldsymbol{Z}} \boldsymbol{X}_{2}\) 是仪器 \(Z\) 上内生回归变量 \(Y_{2}\) 多元回归的简化残差。使用此 IV 公式表达 LIML 对于方差估计非常有用。

LIML 估计量具有与 2SLS 相同的渐近分布。然而,它们在有限样本中的行为却截然不同。有大量证据表明,当有许多仪器或简化形式很弱时,LIML 估计器相对于 2 SLS 减少了有限样本偏差。 (我们将在以下部分回顾这些案例。)然而,另一方面,LIML 具有更广泛的有限样本离散度。

现在我们推导出表达式(12.37)。使用归一化 \(\gamma^{\prime}=\left[\begin{array}{ll}1 & -\beta_{2}^{\prime}\end{array}\right]\) 将 (12.34) 写为

\[ \widehat{\beta}_{2}=\underset{\beta_{2}}{\operatorname{argmin}} \frac{\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \beta_{2}\right)^{\prime} \boldsymbol{M}_{1}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \beta_{2}\right)}{\left(\boldsymbol{Y}_{1}-\boldsymbol{Y} \beta_{2}\right)^{\prime} \boldsymbol{M}_{\boldsymbol{Z}}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \beta_{2}\right)} . \]

最小化的一阶条件是 \(2 /\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)^{\prime} \boldsymbol{M}_{\boldsymbol{Z}}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)\) 次

\[ \begin{aligned} 0 &=\boldsymbol{Y}_{2}^{\prime} \boldsymbol{M}_{1}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)-\frac{\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)^{\prime} \boldsymbol{M}_{1}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)}{\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)^{\prime} \boldsymbol{M}_{\boldsymbol{Z}}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)} \boldsymbol{X}_{2}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right) \\ &=\boldsymbol{Y}_{2}^{\prime} \boldsymbol{M}_{1}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)-\widehat{\kappa} \boldsymbol{X}_{2}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right) \end{aligned} \]

使用定义(12.36)。重写,

\[ \boldsymbol{Y}_{2}^{\prime}\left(\boldsymbol{M}_{1}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{X}_{2} \widehat{\beta}_{2}=\boldsymbol{X}_{2}^{\prime}\left(\boldsymbol{M}_{1}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{Y}_{1} . \]

方程(12.37)与二元方程组相同

\[ \begin{aligned} \boldsymbol{Z}_{1}^{\prime} \boldsymbol{Z}_{1} \widehat{\beta}_{1}+\boldsymbol{Z}_{1}^{\prime} \boldsymbol{Y}_{2} \widehat{\beta}_{2} &=\boldsymbol{Z}_{1}^{\prime} \boldsymbol{Y}_{1} \\ \boldsymbol{Y}_{2}^{\prime} \boldsymbol{Z}_{1} \widehat{\beta}_{1}+\left(\boldsymbol{Y}_{2}^{\prime}\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{Y}_{2}\right) \widehat{\beta}_{2} &=\boldsymbol{Y}_{2}^{\prime}\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{Y}_{1} . \end{aligned} \]

第一个方程是(12.35)。使用 (12.35),第二个是

\[ \boldsymbol{Y}_{2}^{\prime} \boldsymbol{Z}_{1}\left(\boldsymbol{Z}_{1}^{\prime} \boldsymbol{Z}_{1}\right)^{-1} \boldsymbol{Z}_{1}^{\prime}\left(\boldsymbol{Y}_{1}-\boldsymbol{Y}_{2} \widehat{\beta}_{2}\right)+\left(\boldsymbol{Y}_{2}^{\prime}\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{Y}_{2}\right) \widehat{\beta}_{2}=\boldsymbol{Y}_{2}^{\prime}\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{Y}_{1} \]

重新排列后为 (12.38)。因此,我们证明 (12.37) 等价于 (12.35) 和 (12.38),因此是 LIML 估计器的有效表达式。

回到卡学院邻近示例,我们现在使用两种工具(公共、私人)呈现方程的 LIML 估计。它们在表 12.1 的最后一栏中报告。它们与 2SLS 估计非常相似。

LIML 估计量可以在 Stata 中使用 ivregress liml 命令进行计算。

| Theodore Anderson |

|---|

| Theodore (Ted) Anderson (1918-2016) was a American statistician and econo- |

| metrician, who made fundamental contributions to multivariate statistical the- |

| ory. Important contributions include the Anderson-Darling distribution test, the |

| Anderson-Rubin statistic, the method of reduced rank regression, and his most |

| famous econometrics contribution - the LIML estimator. He continued working |

| throughout his long life, even publishing theoretical work at the age of 97 ! |

12.14 分割样本 IV 和 JIVE

估计 \(\beta\) 的理想工具是 \(W=\Gamma^{\prime} Z\)。我们可以将理想的 IV 估计量写为

\[ \widehat{\beta}_{\text {ideal }}=\left(\sum_{i=1}^{n} W_{i} X_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} W_{i} Y_{i}\right) . \]

该估计器不可行,因为 \(\Gamma\) 未知。 2SLS 估计器将 \(\Gamma\) 替换为多元最小二乘估计器 \(\widehat{\Gamma}\),并将 \(W_{i}\) 替换为 \(\widehat{W}_{i}=\widehat{\Gamma}^{\prime} Z_{i}\),从而得到以下 2SLS 表示

\[ \widehat{\beta}_{2 \text { sls }}=\left(\sum_{i=1}^{n} \widehat{W}_{i} X_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} \widehat{W}_{i} Y_{i}\right) . \]

由于 \(\widehat{\Gamma}\) 是在包括观察 \(i\) 在内的完整样本上估计的,因此它是简化形式误差 \(u\) 的函数,而 \(u\) 与结构误差 \(e\) 相关。由此可见,\(\widehat{W}\) 和 \(e\) 是相关的,这意味着 \(\widehat{\beta}_{2 s l s}\) 偏向于 \(\beta\)。这种相关性和偏差逐渐消失,但在应用中可能很重要。

此问题的一个可能的解决方案是将 \(\widehat{W}\) 替换为与错误 \(e\) 不相关的预测值。一种方法是 Angrist 和 Krueger (1995) 的分割样本 IV (SSIV) 估计器。将样本随机分为两个独立的两半 \(A\) 和 \(B\)。使用 \(A\) 估计简化形式,使用 \(B\) 估计结构系数。具体来说,使用样本 \(A\) 构建 \(\widehat{\Gamma}_{A}=\left(\boldsymbol{Z}_{A}^{\prime} \boldsymbol{Z}_{A}\right)^{-1}\left(\boldsymbol{Z}_{A}^{\prime} \boldsymbol{X}_{A}\right)\)。将此与样本 \(B\) 结合起来创建预测值 \(\widehat{W}\)。 SSIV 估计器是 \(\widehat{W}\) \(\widehat{W}\)。这比 \(\widehat{W}\) 具有更低的偏差

SSIV 的局限性在于结果对样本分割很敏感。一次分裂将产生一个估计器;另一次分裂将产生不同的估计量。任何特定的分割都是任意的,因此估计器取决于样本 \(A\) 和 \(B\) 中观测值的特定随机排序。 SSIV 的第二个限制是,当样本量 \(n\) 较小时,它不太可能发挥良好作用。

通过 \(\Gamma\) 的留一估计器可以获得更好的解决方案。具体来说,让

\[ \widehat{\Gamma}_{(-i)}=\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}-Z_{i} Z_{i}^{\prime}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}-Z_{i} X_{i}^{\prime}\right) \]

是简化形式矩阵 \(\Gamma\) 的最小二乘留一估计,并让 \(\widehat{W}_{i}=\widehat{\Gamma}_{(-i)}^{\prime} Z_{i}\) 是简化形式预测值。使用 \(\widehat{W}_{i}=\widehat{\Gamma}_{(-i)}^{\prime} Z_{i}\) 作为工具,我们获得了估计器

\[ \widehat{\beta}_{\mathrm{jive1}}=\left(\sum_{i=1}^{n} \widehat{W}_{i} X_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} \widehat{W}_{i} Y_{i}\right)=\left(\sum_{i=1}^{n} \widehat{\Gamma}_{(-i)}^{\prime} Z_{i} X_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} \widehat{\Gamma}_{(-i)}^{\prime} Z_{i} Y_{i}\right) . \]

Angrist、Imbens 和 Krueger (1999) 将其称为折刀工具变量 (JIVE1) 估计器。它首次出现在《菲利普斯与黑尔》(Phillips and Hale,1977)中。

Angrist、Imbens 和 Krueger (1999) 指出,稍微简单一些的调整也可以消除相关性和偏差。定义估计器和预测值

\[ \begin{aligned} \widetilde{\Gamma}_{(-i)} &=\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}-Z_{i} X_{i}^{\prime}\right) \\ \widetilde{W}_{i} &=\widetilde{\Gamma}_{(-i)}^{\prime} Z_{i} \end{aligned} \]

它仅调整 \(\boldsymbol{Z}^{\prime} \boldsymbol{X}\) 组件。他们的 JIVE2 估计器是

\[ \widehat{\beta}_{\mathrm{jive} 2}=\left(\sum_{i=1}^{n} \widetilde{W}_{i} X_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} \widetilde{W}_{i} Y_{i}\right)=\left(\sum_{i=1}^{n} \widetilde{\Gamma}_{(-i)}^{\prime} Z_{i} X_{i}^{\prime}\right)^{-1}\left(\sum_{i=1}^{n} \widetilde{\Gamma}_{(-i)}^{\prime} Z_{i} Y_{i}\right) . \]

使用留一法估计器的公式(定理 3.7),JIVE1 和 JIVE2 估计器使用两个线性运算:第一个用于创建预测值 \(\widehat{W}_{i}\) 或 \(\widetilde{W}_{i}\),第二个用于计算 IV 估计器。因此,估计器不需要比 2SLS 更多的计算量。

JIVE1 和 JIVE2 的渐近分布理论由 Chao、Swanson、Hausman、Newey 和 Woutersen (2012) 开发。

JIVE1 和 JIVE2 估计量可以在 Stata 中使用 \(j\) ive 命令进行计算。它不是标准包的一部分,但可以轻松添加。

12.15 2SLS的一致性

我们现在证明结构参数的 2SLS 估计器的一致性。以下是一组正则条件。

假设 $12.1

- 变量 \(\left(Y_{1 i}, X_{i}, Z_{i}\right), i=1, \ldots, n\) 是独立且同分布的。

2.\(\mathbb{E}\left[Y_{1}^{2}\right]<\infty\)。

3.\(\mathbb{E}\|X\|^{2}<\infty\)。

4.\(\mathbb{E}\|Z\|^{2}<\infty\)

\(\mathbb{E}\left[Z Z^{\prime}\right]\) 是正定的。

\(\mathbb{E}\left[Z X^{\prime}\right]\) 具有满级 \(k\)。

7.\(\mathbb{E}[Z e]=0\)。

假设 12.1.2-4 表明所有变量都具有有限方差。假设 12.1.5 指出工具向量具有可逆设计矩阵,这与线性回归模型中回归量的核心假设相同。这不包括线性冗余仪器。假设12.1.6和12.1.7是工具变量的关键识别条件。假设 12.1.6 指出工具和回归器具有满秩交叉矩矩阵。这通常称为相关性条件。假设 12.1.7 表明工具变量和结构误差不相关。假设 12.1.5-7 与定义 12.1 相同。

定理 12.1 在假设 12.1 下,\(\widehat{\beta}_{2 s l s} \underset{p}{\longrightarrow} \beta\) 与 \(n \rightarrow \infty\) 相同。

下面提供该定理的证明。

该定理表明,在与最小二乘估计器相似的矩条件下,2SLS 估计器对于结构系数 \(\beta\) 是一致的。主要区别在于工具变量假设 \(\mathbb{E}[Z e]=0\) 和相关条件 \(\operatorname{rank}\left(\mathbb{E}\left[Z X^{\prime}\right]\right)=k\)。

结果包括 IV 估计器(当 \(\ell=k\) 时)作为特例。

这种一致性结果的证明与最小二乘的证明类似。采用矩阵格式的结构方程 \(\boldsymbol{Y}=\boldsymbol{X} \beta+\boldsymbol{e}\) 并将其代入估计器的表达式中。我们获得

\[ \begin{aligned} \widehat{\beta}_{2 \text { sls }} &=\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime}(\boldsymbol{X} \beta+\boldsymbol{e}) \\ &=\beta+\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{e} . \end{aligned} \]

这分离出了随机成分。重写并应用 WLLN 和 CMT

\[ \begin{aligned} \widehat{\beta}_{2 s l s}-\beta &=\left(\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}\right)\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)\right)^{-1} \\ & \times\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}\right)\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{e}\right) \\ \underset{p}{\rightarrow}\left(\boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \boldsymbol{Q}_{Z X}\right)^{-1} \boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \mathbb{E}[Z e]=0 \end{aligned} \]

在哪里

\[ \begin{aligned} &\boldsymbol{Q}_{X Z}=\mathbb{E}\left[X Z^{\prime}\right] \\ &\boldsymbol{Q}_{Z Z}=\mathbb{E}\left[Z Z^{\prime}\right] \\ &\boldsymbol{Q}_{Z X}=\mathbb{E}\left[Z X^{\prime}\right] . \end{aligned} \]

WLLN 在假设 12.1.1 和 12.1.2-4 下成立。如果矩阵 \(\boldsymbol{Q}_{Z Z}\) 和 \(\boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \boldsymbol{Q}_{Z X}\) 可逆,则连续映射定理适用,这在假设 12.1.5 和 12.1.6 下成立。最终的等式使用假设 12.1.7。

12.16 2SLS 的渐近分布

现在我们证明 2SLS 估计器满足中心极限定理。我们首先陈述一组充分的正则性条件。假设 12.2 除假设 12.1 外,

1.\(\mathbb{E}\left[Y_{1}^{4}\right]<\infty\)。

2.\(\mathbb{E}\|X\|^{4}<\infty\)。

3.\(\mathbb{E}\|Z\|^{4}<\infty\)。

- \(\Omega=\mathbb{E}\left[Z Z^{\prime} e^{2}\right]\) 是正定的。

假设 \(12.2\) 通过要求因变量和工具具有有限的四阶矩来强化假设 \(12.1\)。这用于建立中心极限定理。

定理 12.2 根据假设 12.2,作为 \(n \rightarrow \infty\)。

\[ \sqrt{n}\left(\widehat{\beta}_{2 \text { sls }}-\beta\right) \underset{d}{\longrightarrow} \mathrm{N}\left(0, V_{\beta}\right) \]

在哪里

\[ \boldsymbol{V}_{\beta}=\left(\boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \boldsymbol{Q}_{Z X}\right)^{-1}\left(\boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \Omega \boldsymbol{Q}_{Z Z}^{-1} \boldsymbol{Q}_{Z X}\right)\left(\boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \boldsymbol{Q}_{Z X}\right)^{-1} \]

这表明 2 SLS 估计器以 \(\sqrt{n}\) 速率收敛到正态随机向量。它还显示了协方差矩阵的形式。后者采用比最小二乘估计器更为复杂的形式。

与最小二乘估计的情况一样,渐近方差在条件同方差条件下得到简化。对于 2SLS,当 \(\mathbb{E}\left[e^{2} \mid Z\right]=\sigma^{2}\) 时会进行简化。当 \(Z\) 和 \(e\) 独立时,这成立。在某些情况下,认为错误 \(e\) 与排除的工具 \(Z_{2}\) 无关可能是合理的,因为假设 \(Z_{2}\) 对 \(Y\) 的影响仅通过 \(X\) 产生,但没有理由期望 \(e\) 独立于包含的外生变量 \(\mathbb{E}\left[e^{2} \mid Z\right]=\sigma^{2}\)。因此,在 2SLS 和最小二乘回归中应该同样预期异方差性。然而,在同方差下,我们有 \(\mathbb{E}\left[e^{2} \mid Z\right]=\sigma^{2}\) 和 \(\mathbb{E}\left[e^{2} \mid Z\right]=\sigma^{2}\) 的简化。

渐近分布的推导建立在一致性证明的基础上。使用方程(12.39)我们有

\[ \sqrt{n}\left(\widehat{\beta}_{2 \mathrm{sls}}-\beta\right)=\left(\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}\right)\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)\right)^{-1}\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}\right)\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\frac{1}{\sqrt{n}} \boldsymbol{Z}^{\prime} \boldsymbol{e}\right) \text {. } \]

我们将 WLLN 和 CMT 应用于涉及 \(X\) 和 \(\boldsymbol{Z}\) 的矩矩阵,与一致性证明中的相同。此外,由 CLT 进行 i.i.d.观察

\[ \frac{1}{\sqrt{n}} \boldsymbol{Z}^{\prime} \boldsymbol{e}=\frac{1}{\sqrt{n}} \sum_{i=1}^{n} Z_{i} e_{i} \underset{d}{\longrightarrow} \mathrm{N}(0, \Omega) \]

因为向量 \(Z_{i} e_{i}\) 是独立同分布的。在假设 12.1.1 和 12.1.7 下均值为零,并且具有有限二阶矩,正如我们在下面验证的那样。我们获得

\[ \begin{aligned} \sqrt{n}\left(\widehat{\beta}_{2 \text { sls }}-\beta\right) &=\left(\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}\right)\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)\right)^{-1}\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}\right)\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\frac{1}{\sqrt{n}} \boldsymbol{Z}^{\prime} \boldsymbol{e}\right) \\ & \underset{d}{\rightarrow}\left(\boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \boldsymbol{Q}_{Z X}\right)^{-1} \boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \mathrm{~N}(0, \Omega)=\mathrm{N}\left(0, \boldsymbol{V}_{\beta}\right) \end{aligned} \]

就像声明的那样。

为了完成证明,我们证明 \(Z e\) 在假设 12.2 下具有有限二阶矩。要了解这一点,请注意 Minkowski 不等式 (B.34)

\[ \left(\mathbb{E}\left[e^{4}\right]\right)^{1 / 4}=\left(\mathbb{E}\left[\left(Y_{1}-X^{\prime} \beta\right)^{4}\right]\right)^{1 / 4} \leq\left(\mathbb{E}\left[Y_{1}^{4}\right]\right)^{1 / 4}+\|\beta\|\left(\mathbb{E}\|X\|^{4}\right)^{1 / 4}<\infty \]

根据假设 12.2.1 和 12.2.2。然后由 Cauchy-Schwarz 不等式 (B.32)

\[ \mathbb{E}\|Z e\|^{2} \leq\left(\mathbb{E}\|Z\|^{4}\right)^{1 / 2}\left(\mathbb{E}\left[e^{4}\right]\right)^{1 / 2}<\infty \]

使用假设 12.2.3。

12.17 2 SLS 方差的决定因素

检查 2SLS 估计量的渐近方差有助于了解决定估计量精度(或缺乏精度)的因素。与最小二乘情况一样,在同方差假设下检查方差更加透明。在这种情况下,渐近方差的形式为

\[ \begin{aligned} \boldsymbol{V}_{\beta}^{0} &=\left(\boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \boldsymbol{Q}_{Z X}\right)^{-1} \sigma^{2} \\ &=\left(\mathbb{E}\left[X Z^{\prime}\right]\left(\mathbb{E}\left[Z Z^{\prime}\right]\right)^{-1} \mathbb{E}\left[Z X^{\prime}\right]\right)^{-1} \mathbb{E}\left[e^{2}\right] . \end{aligned} \]

在最小二乘情况下,我们可以看到 \(\widehat{\beta}_{2 \text { sls }}\) 的方差在误差 \(e\) 的方差中增加,而 \(X\) 的方差在减少。不同之处在于 \(X\) 和 \(Z\) 之间(矩阵值)相关性的方差正在减小。

观察方差表达式不受 \(Z\) 方差结构的影响也很有用。事实上,\(\boldsymbol{V}_{\beta}^{0}\) 对于 \(Z\) 的旋转是不变的(如果将 \(Z\) 替换为 \(\boldsymbol{C Z}\),以实现可逆的 \(\boldsymbol{C}\),则表达式不会改变)。这意味着方差表达式不受 \(Z\) 缩放的影响,也不受 \(Z\) 之间相关性的直接影响。

我们还可以使用这个表达式来检查增加工具集的影响。假设我们对 \(Z=\left(Z_{a}, Z_{b}\right)\) 和 \(\operatorname{dim}\left(Z_{a}\right) \geq k\) 进行分区,这样我们就可以单独使用 \(Z_{a}\) 构建一个 2SLS 估计器。让 \(\widehat{\beta}_{a}\) 和 \(\widehat{\beta}\) 分别表示使用工具集 \(Z_{a}\) 和 \(\left(Z_{a}, Z_{b}\right)\) 构建的 2SLS 估计器。不失一般性,我们可以假设 \(Z_{a}\) 和 \(Z_{b}\) 不相关(如果不相关,则将 \(Z=\left(Z_{a}, Z_{b}\right)\) 替换为投影到 \(Z=\left(Z_{a}, Z_{b}\right)\) 后的投影误差)。在这种情况下 \(Z=\left(Z_{a}, Z_{b}\right)\) 和 \(Z=\left(Z_{a}, Z_{b}\right)\) 都是块对角线所以

\[ \begin{aligned} \operatorname{avar}[\widehat{\beta}] &=\left(\mathbb{E}\left[X Z^{\prime}\right]\left(\mathbb{E}\left[Z Z^{\prime}\right]\right)^{-1} \mathbb{E}\left[Z X^{\prime}\right]\right)^{-1} \sigma^{2} \\ &=\left(\mathbb{E}\left[X Z_{a}^{\prime}\right]\left(\mathbb{E}\left[Z_{a} Z_{a}^{\prime}\right]\right)^{-1} \mathbb{E}\left[Z_{a} X^{\prime}\right]+\mathbb{E}\left[X Z_{b}^{\prime}\right]\left(\mathbb{E}\left[Z_{b} Z_{b}^{\prime}\right]\right)^{-1} \mathbb{E}\left[Z_{b} X^{\prime}\right]\right)^{-1} \sigma^{2} \\ & \leq\left(\mathbb{E}\left[X Z_{a}^{\prime}\right]\left(\mathbb{E}\left[Z_{a} Z_{a}^{\prime}\right]\right)^{-1} \mathbb{E}\left[Z_{a} X^{\prime}\right]\right)^{-1} \sigma^{2} \\ &=\operatorname{avar}\left[\widehat{\beta}_{a}\right] \end{aligned} \]

严格不等式 if \(\mathbb{E}\left[X Z_{b}^{\prime}\right] \neq 0\)。因此,具有完整工具集的 2SLS 估计器比具有较小工具集的估计器具有更小的渐近方差。

我们已经证明,2SLS 估计量的渐近方差随着仪器数量的增加而减小。从渐近效率的角度来看,这意味着最好使用更多的工具(当它们可用并且都已知是有效的工具时)。

不幸的是,有一个问题。事实证明,2SLS 估计器的有限样本偏差(无法精确计算,但可以使用渐近展开式进行近似)通常随着仪器数量的增加而线性增加。我们将在 12.37 节中看到一些说明这种现象的计算。因此,实践中工具的选择会导致偏差和方差之间的权衡。

12.18 协方差矩阵估计

渐近协方差矩阵 \(\boldsymbol{V}_{\beta}\) 的估计是使用与最小二乘估计类似的技术来完成的。估计量是通过用样本对应矩阵替换总体矩矩阵来构建的。因此

\[ \widehat{\boldsymbol{V}}_{\beta}=\left(\widehat{\mathbf{Q}}_{X Z} \widehat{\mathbf{Q}}_{Z Z}^{-1} \widehat{\mathbf{Q}}_{Z X}\right)^{-1}\left(\widehat{\mathbf{Q}}_{X Z} \widehat{\mathbf{Q}}_{Z Z}^{-1} \widehat{\Omega} \widehat{\mathbf{Q}}_{Z Z}^{-1} \widehat{\mathbf{Q}}_{Z X}\right)\left(\widehat{\mathbf{Q}}_{X Z} \widehat{\mathbf{Q}}_{Z Z}^{-1} \widehat{\mathbf{Q}}_{Z X}\right)^{-1} \]

在哪里

\[ \begin{aligned} \widehat{\boldsymbol{Q}}_{Z Z} &=\frac{1}{n} \sum_{i=1}^{n} Z_{i} Z_{i}^{\prime}=\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z} \\ \widehat{\boldsymbol{Q}}_{X Z} &=\frac{1}{n} \sum_{i=1}^{n} X_{i} Z_{i}^{\prime}=\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z} \\ \widehat{\Omega} &=\frac{1}{n} \sum_{i=1}^{n} Z_{i} Z_{i}^{\prime} \widehat{e}_{i}^{2} \\ \widehat{e}_{i} &=Y_{i}-X_{i}^{\prime} \widehat{\beta}_{2 s l s} \end{aligned} \]

同方差协方差矩阵可以通过以下方式估计

\[ \begin{aligned} \widehat{\boldsymbol{V}}_{\beta}^{0} &=\left(\widehat{\boldsymbol{Q}}_{X Z} \widehat{\boldsymbol{Q}}_{Z Z}^{-1} \widehat{\boldsymbol{Q}}_{Z X}\right)^{-1} \widehat{\sigma}^{2} \\ \widehat{\sigma}^{2} &=\frac{1}{n} \sum_{i=1}^{n} \widehat{e}_{i}^{2} \end{aligned} \]

系数的标准误差通过 \(n^{-1} \widehat{\boldsymbol{V}}_{\beta}\) 对角线元素的平方根获得。置信区间、t 检验和 Wald 检验都可以按照与最小二乘回归完全相同的系数和协方差矩阵估计来构建。

在 Stata 中,ivregress 命令默认使用同方差协方差矩阵计算协方差矩阵估计量。要使用稳健估计器 \(\widehat{\boldsymbol{V}}_{\beta}\) 获得协方差矩阵估计和标准误差,请使用“,r”选项。

定理12.3 在假设12.2 下,如\(n \rightarrow \infty, \widehat{\boldsymbol{V}}_{\beta}^{0}{\underset{p}{\longrightarrow}}^{\boldsymbol{V}_{\beta}^{0}}\) 和\(\widehat{\boldsymbol{V}}_{\beta} \vec{p}^{\boldsymbol{V}_{\beta}}\) 证明定理\(12.3\) 的关键是要证明\(\widehat{\Omega} \vec{p} \Omega\) 与一致性证明中其他收敛结果一样。我们将其推迟到练习 12.6。

使用正确的残差公式 \(\widehat{e}_{i}=Y_{i}-\) \(X_{i}^{\prime} \widehat{\beta}_{2 \text { sls }}\) 构建协方差矩阵非常重要。这与使用“两阶段”计算方法所获得的结果不同。为了了解这一点,让我们逐步了解一下两阶段方法。首先,我们估计简化形式 \(X_{i}=\widehat{\Gamma}^{\prime} Z_{i}+\widehat{u}_{i}\) 以获得预测值 \(\widehat{X}_{i}=\widehat{\Gamma}^{\prime} Z_{i}\)。其次,我们在 \(\widehat{X}\) 上回归 \(Y\) 以获得 2SLS 估计器 \(\widehat{\beta}_{2 \text { sls }}\)。后一个回归采用以下形式

\[ Y_{i}=\widehat{X}_{i}^{\prime} \widehat{\beta}_{2 \mathrm{sls}}+\widehat{v}_{i} \]

其中 \(\widehat{v}_{i}\) 是最小二乘残差。此回归报告的协方差矩阵(和标准误差)是使用残差 \(\widehat{v}_{i}\) 构建的。例如,同方差公式为

\[ \begin{aligned} \widehat{\boldsymbol{V}}_{\beta} &=\left(\frac{1}{n} \widehat{\boldsymbol{X}}^{\prime} \widehat{\boldsymbol{X}}\right)^{-1} \widehat{\sigma}_{v}^{2}=\left(\widehat{\boldsymbol{Q}}_{X Z} \widehat{\boldsymbol{Q}}_{Z Z}^{-1} \widehat{\mathbf{Q}}_{Z X}\right)^{-1} \widehat{\sigma}_{v}^{2} \\ \widehat{\sigma}_{v}^{2} &=\frac{1}{n} \sum_{i=1}^{n} \widehat{v}_{i}^{2} \end{aligned} \]

它与方差估计器 \(\widehat{\sigma}_{v}^{2}\) 成正比,而不是与 \(\widehat{\sigma}^{2}\) 成正比。这很重要,因为残差 \(\widehat{v}\) 与 \(\widehat{e}\) 不同。我们可以看到这一点,因为回归 (12.41) 使用回归器 \(\widehat{X}\) 而不是 \(X\)。确实,我们计算出

\[ \widehat{v}_{i}=Y_{i}-X_{i}^{\prime} \widehat{\beta}_{2 \mathrm{sls}}+\left(X_{i}-\widehat{X}_{i}\right)^{\prime} \widehat{\beta}_{2 \mathrm{sls}}=\widehat{e}_{i}+\widehat{u}_{i}^{\prime} \widehat{\beta}_{2 \mathrm{sls}} \neq \widehat{e}_{i} \text {. } \]

这意味着回归报告的标准误差 (12.41) 将不正确。

如果直接构造 2SLS 估计器并使用正确的公式计算标准误差而不是采取“两步”捷径,则可以避免此问题。

12.19 LIML 渐近分布

在本节中,我们将证明 LIML 估计器渐近等价于 2SLS 估计器。然而,我们建议使用基于 IV 表示的不同协方差矩阵估计器。

我们首先推导渐近分布。回想一下,LIML 估计器有多种表示形式,包括

\[ \widehat{\beta}_{\mathrm{liml}}=\left(\boldsymbol{X}^{\prime}\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{X}\right)^{-1}\left(\boldsymbol{X}^{\prime}\left(\boldsymbol{I}_{n}-\widehat{\kappa} \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{Y}_{1}\right) \]

在哪里

\[ \widehat{\boldsymbol{\kappa}}=\min _{\gamma} \frac{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{1} \overrightarrow{\boldsymbol{Y}} \gamma}{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}} \overrightarrow{\boldsymbol{Y}} \gamma} \]

和 \(\gamma=\left(1,-\beta_{2}^{\prime}\right)^{\prime}\)。对于分布理论,将斜率系数重写为

\[ \widehat{\beta}_{\mathrm{liml}}=\left(\boldsymbol{X}^{\prime} \boldsymbol{P}_{Z} \boldsymbol{X}-\widehat{\mu} \boldsymbol{X}^{\prime} \boldsymbol{M}_{Z} \boldsymbol{X}\right)^{-1}\left(\boldsymbol{X}^{\prime} \boldsymbol{P}_{\boldsymbol{Z}} \boldsymbol{Y}_{1}-\widehat{\mu} \boldsymbol{X}^{\prime} \boldsymbol{M}_{Z} \boldsymbol{Y}_{1}\right) \]

在哪里

\[ \widehat{\mu}=\widehat{\kappa}-1=\min _{\gamma} \frac{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{1} \boldsymbol{Z}_{2}\left(\boldsymbol{Z}_{2}^{\prime} \boldsymbol{M}_{1} \boldsymbol{Z}_{2}\right)^{-1} \boldsymbol{Z}_{2}^{\prime} \boldsymbol{M}_{1} \overrightarrow{\boldsymbol{Y}} \gamma}{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}} \overrightarrow{\boldsymbol{Y}} \gamma} \text {. } \]

第二个等式成立,因为 \(\boldsymbol{Z}=\left[\boldsymbol{Z}_{1}, \boldsymbol{Z}_{2}\right]\) 的跨度等于 \(\left[\boldsymbol{Z}_{1}, \boldsymbol{M}_{1} \boldsymbol{Z}_{2}\right]\) 的跨度。这意味着

\[ \boldsymbol{P}_{\boldsymbol{Z}}=\boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime}=\boldsymbol{Z}_{1}\left(\boldsymbol{Z}_{1}^{\prime} \boldsymbol{Z}_{1}\right)^{-1} \boldsymbol{Z}_{1}^{\prime}+\boldsymbol{M}_{1} \boldsymbol{Z}_{2}\left(\boldsymbol{Z}_{2}^{\prime} \boldsymbol{M}_{1} \boldsymbol{Z}_{2}\right)^{-1} \boldsymbol{Z}_{2}^{\prime} \boldsymbol{M}_{1} \]

我们现在证明\(n \widehat{\mu}=O_{p}(1)\)。简化形式 (12.33) 意味着

\[ \boldsymbol{Y}=\boldsymbol{Z}_{1} \Pi_{1}+\boldsymbol{Z}_{2} \Pi_{2}+\boldsymbol{e} . \]

值得注意的是

\[ \Pi_{2}=\left[\lambda_{2}, \Gamma_{22}\right]=\left[\Gamma_{22} \beta_{2}, \Gamma_{22}\right] \]

使用(12.15)。由此可知\(\Pi_{2} \gamma=0\)。注意\(\boldsymbol{U} \gamma=\boldsymbol{e}\)。然后是 \(\boldsymbol{M}_{\boldsymbol{Z}} \boldsymbol{Y} \gamma=\boldsymbol{M}_{\boldsymbol{Z}} \boldsymbol{e}\) 和 \(\boldsymbol{M}_{1} \boldsymbol{Y} \gamma=\boldsymbol{M}_{1} \boldsymbol{e}\)。因此

\[ \begin{aligned} n \widehat{\mu} &=\min _{\gamma} \frac{\gamma^{\prime} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{1} \boldsymbol{Z}_{2}\left(\boldsymbol{Z}_{2}^{\prime} \boldsymbol{M}_{1} \boldsymbol{Z}_{2}\right)^{-1} \boldsymbol{Z}_{2}^{\prime} \boldsymbol{M}_{1} \overrightarrow{\boldsymbol{Y}} \gamma}{\gamma^{\prime} \frac{1}{n} \overrightarrow{\boldsymbol{Y}}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}} \overrightarrow{\boldsymbol{Y}} \gamma} \\ & \leq \frac{\left(\frac{1}{\sqrt{n}} \boldsymbol{e}^{\prime} \boldsymbol{M}_{1} \boldsymbol{Z}_{2}\right)\left(\frac{1}{n} \boldsymbol{Z}_{2}^{\prime} \boldsymbol{M}_{1} \boldsymbol{Z}_{2}\right)^{-1}\left(\frac{1}{\sqrt{n}} \boldsymbol{Z}_{2}^{\prime} \boldsymbol{M}_{1} \boldsymbol{e}\right)}{\frac{1}{n} \boldsymbol{e}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}} \boldsymbol{e}} \\ &=O_{p}(1) . \end{aligned} \]

它遵循

\[ \begin{aligned} \sqrt{n}\left(\widehat{\beta}_{\mathrm{liml}}-\beta\right) &=\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{P}_{Z} \boldsymbol{X}-\widehat{\mu} \frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{M}_{\boldsymbol{Z}} \boldsymbol{X}\right)^{-1}\left(\frac{1}{\sqrt{n}} \boldsymbol{X}^{\prime} \boldsymbol{P}_{Z} \boldsymbol{e}-\sqrt{n} \widehat{\mu} \frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{M}_{Z} \boldsymbol{e}\right) \\ &=\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{P}_{Z} \boldsymbol{X}-o_{p}(1)\right)^{-1}\left(\frac{1}{\sqrt{n}} \boldsymbol{X}^{\prime} \boldsymbol{P}_{Z} \boldsymbol{e}-o_{p}(1)\right) \\ &=\sqrt{n}\left(\widehat{\beta}_{2 \mathrm{sls}}-\beta\right)+o_{p}(1) \end{aligned} \]

这意味着 LIML 和 2SLS 具有相同的渐近分布。这在与 2SLS 相同的假设下成立。

因此,获得 LIML 渐近有效协方差估计量的一种方法是使用 2SLS 公式。然而,这并不是最好的选择。相反,考虑 LIML 的 IV 表示

\[ \widehat{\beta}_{\mathrm{liml}}=\left(\widetilde{\boldsymbol{X}}^{\prime} \boldsymbol{X}\right)^{-1}\left(\widetilde{\boldsymbol{X}}^{\prime} \boldsymbol{Y}_{1}\right) \]

在哪里

\[ \widetilde{\boldsymbol{X}}=\left(\begin{array}{c} \boldsymbol{X}_{1} \\ \boldsymbol{X}_{2}-\widehat{\boldsymbol{K}}_{2} \end{array}\right) \]

和 \(\widehat{\boldsymbol{U}}_{2}=\boldsymbol{M}_{\boldsymbol{Z}} \boldsymbol{X}_{2}\)。 IV 估计量的渐近协方差矩阵公式为

\[ \widehat{\boldsymbol{V}}_{\beta}=\left(\frac{1}{n} \widetilde{\boldsymbol{X}}^{\prime} \boldsymbol{X}\right)^{-1} \widehat{\Omega}\left(\frac{1}{n} \boldsymbol{X}^{\prime} \tilde{\boldsymbol{X}}\right)^{-1} \]

在哪里

\[ \begin{aligned} \widehat{\Omega} &=\frac{1}{n} \sum_{i=1}^{n} \widetilde{X}_{i} \widetilde{X}_{i} \widehat{e}_{i}^{2} \\ \widehat{e}_{i} &=Y_{1 i}-X_{i}^{\prime} \widehat{\beta}_{\text {liml }} . \end{aligned} \]

当 \(\widehat{\kappa}=1\) 时,这简化为 2SLS 公式,但在其他方面有所不同。对于协方差矩阵估计,估计器 (12.42) 是比 2SLS 公式更好的选择,因为它利用了 LIML 估计器结构。

12.20 参数功能

给定定理 \(12.2\) 和 \(12.3\) 中的分布理论,可以直接导出系数估计量的平滑非线性函数的渐近分布。

具体来说,给定函数 \(r(\beta): \mathbb{R}^{k} \rightarrow \Theta \subset \mathbb{R}^{q}\),我们定义参数 \(\theta=r(\beta)\)。给定 \(\widehat{\beta}_{2 \text { sls }}\),\(\theta\) 的自然估计量是 \(\widehat{\theta}_{2 \text { sls }}=r\left(\widehat{\beta}_{2 \text { sls }}\right)\)。

一致性来自定理 \(12.1\) 和连续映射定理。

定理 12.4 在假设 \(12.1\) 和 7.3 下,作为 \(n \rightarrow \infty, \widehat{\theta}_{2 s l s} \underset{p}{\longrightarrow} \theta\)

如果 \(r(\beta)\) 可微,则 \(\widehat{\theta}_{2 \text { sls }}\) 的渐近协方差矩阵的估计量为

\[ \begin{aligned} \widehat{\boldsymbol{V}}_{\theta} &=\widehat{\boldsymbol{R}}^{\prime} \widehat{\boldsymbol{V}}_{\beta} \widehat{\boldsymbol{R}} \\ \widehat{\boldsymbol{R}} &=\frac{\partial}{\partial \beta} r\left(\widehat{\beta}_{2 s l s}\right)^{\prime} . \end{aligned} \]

我们类似地将同方差方差估计器定义为 \(\widehat{\boldsymbol{V}}_{\theta}^{0}=\widehat{\boldsymbol{R}}^{\prime} \widehat{\boldsymbol{V}}_{\beta}^{0} \widehat{\boldsymbol{R}}\)。

渐近分布理论源自定理 \(12.2\) 和 \(12.3\) 以及 delta 方法。

定理 12.5 在假设 \(12.2\) 和 \(7.3\) 下,作为 \(n \rightarrow \infty\),

\[ \sqrt{n}\left(\widehat{\theta}_{2 s l s}-\theta\right) \underset{d}{\longrightarrow} \mathrm{N}\left(0, \boldsymbol{V}_{\theta}\right) \]

和 \(\widehat{\boldsymbol{V}}_{\theta} \underset{p}{\longrightarrow} \boldsymbol{V}_{\theta}\) 其中 \(\boldsymbol{V}_{\theta}=\boldsymbol{R}^{\prime} \boldsymbol{V}_{\beta} \boldsymbol{R}\) 和 \(\boldsymbol{R}=\frac{\partial}{\partial \beta} \boldsymbol{r}(\beta)^{\prime}\)

当 \(q=1\) 时,\(\widehat{\theta}_{2 \text { sls }}\) 的标准错误是 \(s\left(\widehat{\theta}_{2 \text { sls }}\right)=\sqrt{n^{-1} \widehat{\boldsymbol{V}}_{\theta}}\)。

例如,我们采用表 12.1 第五列中的参数估计值,它们是具有三个内生回归变量和四个排除工具的 2SLS 估计值。假设我们对回归经验感兴趣,这取决于经验的水平。经验 \(=10\) 的估计回报为 \(0.047-0.032 \times 2 \times 10 / 100=0.041\),其标准误差为 \(0.003\)。这意味着每年经验的工资会增加 \(4 %\),并且是经过精确估计的。或者假设我们对函数最大化的经验水平感兴趣。估计是 \(50 \times 0.047 / 0.032=73\)。标准误差为 249 。较大的标准误差意味着该估计(73 年的经验)不精确,因此缺乏信息。

12.21 假设检验

与上一节一样,对于给定函数 \(r(\beta): \mathbb{R}^{k} \rightarrow \Theta \subset \mathbb{R}^{q}\),我们定义参数 \(\theta=r(\beta)\) 并考虑 \(\mathbb{M}_{0}: \theta=\theta_{0}\) 与 \(\mathbb{H}_{1}: \theta \neq \theta_{0}\) 形式的假设检验。 \(\mathbb{M}_{0}\) 的 Wald 统计量为

\[ W=n\left(\widehat{\theta}-\theta_{0}\right)^{\prime} \widehat{\boldsymbol{V}}_{\widehat{\theta}}^{-1}\left(\widehat{\theta}-\theta_{0}\right) . \]

从定理 \(12.5\) 我们推断 \(W\) 是渐近卡方分布的。让 \(G_{q}(u)\) 表示 \(\chi_{q}^{2}\) 分布函数。

定理 12.6 根据假设 12.2、假设 7.3 和 \(\mathbb{H}_{0}\),则为 \(n \rightarrow\) \(\infty, W \underset{d}{\rightarrow} \chi_{q}^{2}\)。对于 \(c\) 满足 \(\alpha=1-G_{q}(c), \mathbb{P}\left[W>c \mid \mathbb{M}_{0}\right] \longrightarrow \alpha\),因此测试“Reject \(\mathbb{M}_{0}\) if \(W>c\)”具有渐近大小 \(\alpha\)。

在线性回归中,我们经常报告 Wald 统计量的 \(F\) 版本(通过除以自由度)并使用 \(F\) 分布进行推理,因为这在正态抽样模型中是合理的。然而,对于 2SLS 估计,不会这样做,因为 Wald 统计量的 \(F\) 版本没有有限样本 \(F\) 理由。

为了说明这一点,我们再次从表 \(12.1\) 的第五列中获取参数估计值,并再次考虑由经验和经验 \(^{2} / 100\) 的系数确定的经验回报。这两个系数在 \(5 %\) 水平上都不具有统计显着性,并且尚不清楚总体效果是否具有统计显着性。我们可以通过检验两个系数均为零的联合假设来评估这一点。该假设的 Wald 统计量为 \(W=244\),它非常显着,渐近 p 值为 \(0.0000\)。因此,通过检查联合测试与单独测试的对比,可以很清楚地看出,经验具有非零效应。

12.22 有限样本理论

在第五章中,我们回顾了在正态创新假设下可用于线性回归模型的丰富的精确分布。 IV、2SLS 和 LIML 估计量的计量经济学文献也同样丰富。 Peter Phillips (1983) 对主要在 20 世纪 70 年代和 1980 年代初发展起来的理论进行了精彩的回顾。

该理论是在结构误差向量 \(e\) 和简化形式误差 \(u_{2}\) 呈多元正态分布的假设下发展起来的。即使误差是正态的,IV 型估计量也是这些误差的非线性函数,因此是非正态分布的。精确分布的公式已经导出,但不幸的是,它们是模型参数的函数,因此不能直接用于有限样本推断。

该文献的一个重要含义是,即使在精确正态创新的最佳背景下,IV 估计量的有限样本分布也是非正态的,并且检验统计量的有限样本分布也不是卡方的。正态近似和卡方近似渐近成立,但没有理由期望这些近似在有限样本中是准确的。

第二个重要结果是,在正态误差的假设下,大多数估计器在任何有限样本中都不具有有限矩。 Kinal (1980) 在联合正态性的情况下获得了关于 2SLS 估计器矩存在性的明确声明。令 \(\widehat{\beta}_{2 s l s, 2}\) 为内生回归量系数的 2SLS 估计量。

定理 \(12.7\) 如果 \((Y, X, Z)\) 是联合正规的,则对于任何 \(r, \mathbb{E}\left\|\widehat{\beta}_{2 s l s, 2}\right\|^{r}<\infty\) 当且仅当 \(r<\ell_{2}-k_{2}+1\)。该结果表明,在刚刚确定的情况下,IV 估计器不具有任何有限阶整数矩。在过度识别的情况下,有限矩的数量对应于过度识别限制 \(\left(\ell_{2}-k_{2}\right)\) 的数量。因此,如果存在一个过度识别限制,则 2SLS 具有有限期望,如果存在两个过度识别限制,则 2SLS 估计量具有有限方差。

LIML 估计器具有更严重的矩问题,因为它没有有限整数矩(Mariano,1982),无论过度识别限制的数量如何。由于缺乏矩,Fuller (1977) 提出了 LIML 的以下修改。他的估计量是

\[ \begin{aligned} \widehat{\beta}_{\text {Fuller }} &=\left(\boldsymbol{X}^{\prime}\left(\boldsymbol{I}_{n}-K \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{X}\right)^{-1}\left(\boldsymbol{X}^{\prime}\left(\boldsymbol{I}_{n}-K \boldsymbol{M}_{\boldsymbol{Z}}\right) \boldsymbol{Y}_{1}\right) \\ K &=\widehat{\kappa}-\frac{C}{n-k} \end{aligned} \]

对于一些 \(C \geq 1\)。富勒表明,他的估计量在适当的条件下具有有限的所有矩。

Hausman、Newey、Woutersen、Chao 和 Swanson(2012)提出了一种称为 HFUL 的估计器,它结合了 JIVE 和 Fuller 的思想,具有出色的有限样本属性。

12.23 2SLS 的引导程序

IV、2SLS 和 GMM 的标准引导算法通过独立采样三元组 \(\left(Y_{1 i}^{*}, X_{i}^{*}, Z_{i}^{*}\right)\) 并替换原始样本 \(\left\{\left(Y_{1 i}, X_{i}, Z_{i}\right): i=\right.\) \(1, \ldots, n\}\) 来生成引导样本。对 \(n\) 这样的观测值进行采样并堆叠到观测矩阵 \(\left(\boldsymbol{Y}_{1}^{*}, \boldsymbol{X}^{*}, \boldsymbol{Z}^{*}\right)\) 中,bootstrap 2SLS 估计器为

\[ \widehat{\beta}_{2 \mathrm{sls}}^{*}=\left(\boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1} \boldsymbol{Z}^{* \prime} \boldsymbol{X}^{*}\right)^{-1} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1} \boldsymbol{Z}^{* \prime} \boldsymbol{Y}_{1}^{*} \]

重复 \(B\) 次以创建 \(B\) 引导绘制的样本。鉴于这些抽签,可以计算自举统计数据。这包括方差、标准误差和置信区间的引导估计,包括百分位数、\(\mathrm{BC}\) 百分位数、\(\mathrm{BC}_{a}\) 和百分位数-t。

我们现在证明自举估计量具有与样本估计量相同的渐近分布。对于过度识别的情况,此演示需要额外小心。 Hahn (1996) 首先表明了这一点。

样本观测值满足模型 \(Y_{1}=X^{\prime} \beta+e\) 和 \(\mathbb{E}[Z e]=0\)。总体中 \(\beta\) 的真实值可以写为

\[ \beta=\left(\mathbb{E}\left[X Z^{\prime}\right] \mathbb{E}\left[Z Z^{\prime}\right]^{-1} \mathbb{E}\left[Z X^{\prime}\right]\right)^{-1} \mathbb{E}\left[X Z^{\prime}\right] \mathbb{E}\left[Z Z^{\prime}\right]^{-1} \mathbb{E}\left[Z Y_{1}\right] \]

Bootstrap宇宙中的真实值是通过用样本矩替换总体矩得到的,它等于2SLS估计器

\[ \begin{aligned} &\left(\mathbb{E}^{*}\left[X^{*} Z^{* \prime}\right] \mathbb{E}^{*}\left[Z^{*} Z^{* \prime}\right]^{-1} \mathbb{E}^{*}\left[Z^{*} X^{* \prime}\right]\right)^{-1} \mathbb{E}^{*}\left[X^{*} Z^{* \prime}\right] \mathbb{E}^{*}\left[Z^{*} Z^{* \prime}\right]^{-1} \mathbb{E}^{*}\left[Z^{*} Y_{1}^{*}\right] \\ &=\left(\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}\right)\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)\right)^{-1}\left(\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}\right)\left(\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left[\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Y}_{1}\right] \\ &=\widehat{\beta}_{2 \text { sls }} . \end{aligned} \]

因此,自举观测值满足方程 \(Y_{1 i}^{*}=X_{i}^{* \prime} \widehat{\beta}_{2 s l s}+e_{i}^{*}\)。在样本的矩阵表示法中,这是

\[ \boldsymbol{Y}_{1}^{*}=\boldsymbol{X}^{* \prime} \widehat{\beta}_{2 \mathrm{sls}}+\boldsymbol{e}^{*} . \]

给定一个引导三元组 \(\left(Y_{1 i}^{*}, X_{i}^{*}, Z_{i}^{*}\right)=\left(Y_{1 j}, X_{j}, Z_{j}\right)\) 对于某些观察 \(j\) ,真正的引导错误是

\[ e_{i}^{*}=Y_{1 j}-X_{j}^{\prime} \widehat{\beta}_{2 s l s}=\widehat{e}_{j} . \]

它遵循

\[ \mathbb{E}^{*}\left[Z^{*} e^{*}\right]=n^{-1} \boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}} . \]

在过度识别的情况下,这通常不等于零。

这是一个重要的并发症。在过度识别模型中,真实观测值满足总体条件 \(\mathbb{E}[Z e]=0\),但在引导样本 \(\mathbb{E}^{*}\left[Z^{*} e^{*}\right] \neq 0\) 中。这意味着要将中心极限定理应用于自举估计器,我们首先必须重新调整矩条件。也就是说,(12.44) 和 bootstrap CLT 意味着

\[ \frac{1}{\sqrt{n}}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{e}^{*}-\boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}}\right)=\frac{1}{\sqrt{n}} \sum_{i=1}^{n}\left(Z_{i}^{*} e_{i}^{*}-\mathbb{E}^{*}\left[Z^{*} e^{*}\right]\right) \underset{d^{*}}{\longrightarrow} \mathrm{N}(0, \Omega) \]

在哪里

\[ \Omega=\mathbb{E}\left[Z Z^{\prime} e^{2}\right] . \]

使用(12.43)我们可以将自举估计量归一化为

\[ \begin{aligned} \sqrt{n}\left(\widehat{\boldsymbol{\beta}}_{2 \mathrm{sls}}^{*}-\widehat{\boldsymbol{\beta}}_{2 \mathrm{sls}}\right) &=\sqrt{n}\left(\boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1} \boldsymbol{Z}^{* \prime} \boldsymbol{X}^{*}\right)^{-1} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1} \boldsymbol{Z}^{* \prime} \boldsymbol{e}^{*} \\ &=\left(\left(\frac{1}{n} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\right)\left(\frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1}\left(\frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{X}^{*}\right)\right)^{-1} \\ & \times\left(\frac{1}{n} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\right)\left(\frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1} \frac{1}{\sqrt{n}}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{e}^{*}-\boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}}\right) \\ &+\left(\left(\frac{1}{n} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\right)\left(\frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1}\left(\frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{X}^{*}\right)\right)^{-1} \\ & \times\left(\frac{1}{n} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\right)\left(\frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1}\left(\frac{1}{\sqrt{n}} \boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}}\right) . \end{aligned} \]

使用引导 WLLN,

\[ \begin{aligned} \frac{1}{n} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*} &=\frac{1}{n} \boldsymbol{X}^{\prime} \boldsymbol{Z}+o_{p}(1) \\ \frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*} &=\frac{1}{n} \boldsymbol{Z}^{\prime} \boldsymbol{Z}+o_{p}(1) . \end{aligned} \]

这意味着 (12.47) 等于

\[ \sqrt{n}\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\boldsymbol{Z}^{\prime} \boldsymbol{X}\right)\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}}+o_{p}(1)=0+o_{p}(1) \]

该等式成立是因为 2SLS 一阶条件意味着 \(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}}=0\)。此外,结合(12.45)我们看到(12.46)在引导分布中收敛为

\[ \left(\boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \boldsymbol{Q}_{Z X}\right)^{-1} \boldsymbol{Q}_{X Z} \boldsymbol{Q}_{Z Z}^{-1} \mathrm{~N}(0, \Omega)=\mathrm{N}\left(0, \boldsymbol{V}_{\beta}\right) \]

其中 \(\boldsymbol{V}_{\beta}\) 是定理 12.2 的 2SLS 渐近方差。这是 \(\sqrt{n}\left(\widehat{\beta}_{2 s l s}^{*}-\widehat{\beta}_{2 s l s}\right)\) 的渐近分布

通过标准计算,我们还可以证明自举 t 比率是渐近正态的。定理 12.8 在假设 12.2 下,如 \(n \rightarrow \infty\)

\[ \sqrt{n}\left(\widehat{\beta}_{2 s l s}^{*}-\widehat{\beta}_{2 s l s}\right) \underset{d^{*}}{\longrightarrow} \mathrm{N}\left(0, \boldsymbol{V}_{\beta}\right) \]

其中 \(\boldsymbol{V}_{\beta}\) 是定理 12.2 的 \(2 \mathrm{SLS}\) 渐近方差。此外,

\[ T^{*}=\frac{\sqrt{n}\left(\widehat{\beta}_{2 s l s}^{*}-\widehat{\beta}_{2 s l s}\right)}{s\left(\widehat{\beta}_{2 \text { sls }}^{*}\right)} \underset{d^{*}}{\longrightarrow} \mathrm{N}(0,1) . \]

这表明百分位数类型和百分位数 t 置信区间是渐近有效的。

人们可能期望渐近求精参数扩展到 \(\mathrm{BC}_{a}\) 和percentile-t 方法,但事实似乎并非如此。虽然 \(\sqrt{n}\left(\widehat{\beta}_{2 \text { sls }}^{*}-\widehat{\beta}_{2 s l s}\right)\) 和 \(\sqrt{n}\left(\widehat{\beta}_{2 s l s}-\beta\right)\) 具有相同的渐近分布,但它们在有限样本中的差异在于 \(O_{p}\left(n^{-1 / 2}\right)\) 项。这意味着它们具有独特的埃奇沃斯展开式。因此,未经调整的引导方法将无法实现渐近细化。

Hall 和 Horowitz (1996) 提出的另一种选择是使 bootstrap 2SLS 估计器居中,使其满足正确的正交条件。定义

\[ \widehat{\beta}_{2 \text { sls }}^{* *}=\left(\boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1} \boldsymbol{Z}^{* \prime} \boldsymbol{X}^{*}\right)^{-1} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1}\left(\boldsymbol{Z}^{* \prime} \boldsymbol{Y}_{1}^{*}-\boldsymbol{Z}^{\prime} \widehat{\boldsymbol{e}}\right) . \]

我们可以看到

\[ \begin{aligned} \sqrt{n}\left(\widehat{\beta}_{2 \text { sls }}^{* *}-\widehat{\beta}_{2 \mathrm{sls}}\right) &=\left(\frac{1}{n} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\left(\frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1} \frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{X}^{*}\right)^{-1} \\ & \times\left(\frac{1}{n} \boldsymbol{X}^{* \prime} \boldsymbol{Z}^{*}\right)\left(\frac{1}{n} \boldsymbol{Z}^{* \prime} \boldsymbol{Z}^{*}\right)^{-1}\left(\frac{1}{\sqrt{n}} \sum_{i=1}^{n}\left(Z_{i}^{*} e_{i}^{*}-\mathbb{E}^{*}\left[Z^{*} e^{*}\right]\right)\right) \end{aligned} \]

无需特殊处理即可收敛到 \(\mathrm{N}\left(0, \boldsymbol{V}_{\beta}\right)\) 分布。 Hall 和 Horowitz (1996) 表明,应用于 \(\widehat{\beta}_{2 \text { sls }}^{* *}\) 的百分位数 t 方法实现了渐近细化,因此优于未调整的引导估计器。

然而,这个重新定位的估计器并不是实证实践中使用的 2SLS 引导程序的标准实现。

12.24 Bootstrap 2SLS 标准错误的危险

使用 bootstrap 算法来估计 2SLS 估计器的方差矩阵和标准误差是很诱人的。事实上,这是当前计量经济学实践中引导方法最常见的用途之一。不幸的是,这是一个不合理且考虑不周的想法,不应该这样做。在有限样本中,2SLS 估计器可能没有有限的二阶矩,这意味着自举方差估计不稳定且不可靠。

定理 \(12.7\) 表明,在联合正态性下,当且仅当过度识别限制的数量为 2 或更大时,2SLS 估计器才会具有有限方差。因此,对于刚刚识别的 IV 和具有一定程度过度识别的 2SLS,有限样本方差是无限的。引导程序将尝试估计这个值 - 无穷大 - 并会产生无意义的答案。当观测值不共同正态时,就不存在有限样本理论(因此有限样本方差实际上可能是有限的),但这是未知且无法验证的。在过度识别设置中,当过度识别限制的数量为两个或更大时,可以应用引导程序进行标准误差估计。然而,这并不是 IV 方法在计量经济学实践中最常见的应用,因此应被视为例外而不是常态。

要了解发生的情况,请考虑刚刚识别的模型的最简单情况,该模型具有单个内生回归变量且不包含外生回归变量。在这种情况下,估计量可以写成均值之比

\[ \widehat{\beta}_{\mathrm{iv}}-\beta=\frac{\sum_{i=1}^{n} Z_{i} e_{i}}{\sum_{i=1}^{n} Z_{i} X_{i}} . \]

在 \((e, X)\) 的联合正态性下,它具有类柯西分布,不具有任何有限整数矩。问题在于分母可以是正数,也可以是负数,并且可以任意接近于零。这意味着该比率可以取任意大的值。

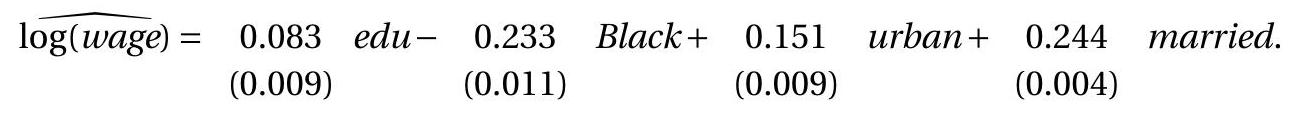

为了说明这一点,让我们回到表 \(12.1\) 第 2 列中的基本 Card IV 工资回归,该回归使用大学作为教育工具。我们针对具有 \(n=703\) 观测值的黑人子样本估计该方程,并重点关注教育回报系数。表 12.3 报告了系数估计值,以及渐近误差、折刀误差和两个自举标准误差,每个标准误差均通过 10,000 次自举重复计算得出。

表 12.3:黑人男性教育回报工具变量

| Estimate | \(0.11\) |

|---|---|

| Asymptotic s.e. | \((0.11)\) |

| Jackknife s.e. | \((0.11)\) |

| Bootstrap s.e. (standard) | \((1.42)\) |

| Bootstrap s.e. (repeat) | \((4.79)\) |

引导程序标准误差比渐近标准误差大一个数量级,并且尽管使用了 10,000 次引导程序复制,但在引导程序运行过程中差异很大。这表明引导程序标准错误的瞬时故障和不可靠性。

这是一个强烈的信息,即不应为 IV 估计器计算自举标准误差。相反,报告百分位数类型的置信区间。

12.25 集群依赖

在 \(4.21\) 节中,我们引入了集群依赖。我们还可以使用聚类依赖的方法进行 2SLS 估计。回想一下,\(g^{t h}\) 集群具有观测值 \(\boldsymbol{Y}_{g}=\left(Y_{1 g}, \ldots, Y_{n_{g} g}\right)^{\prime}, \boldsymbol{X}_{g}=\)、\(\left(X_{1 g}, \ldots, X_{n_{g} g}\right)^{\prime}\) 和 \(Z_{g}=\left(Z_{1 g}, \ldots, Z_{n_{g} g}\right)^{\prime}\)。 \(g^{t h}\) 簇的结构方程可以写为矩阵系统 \(\boldsymbol{Y}_{g}=\boldsymbol{X}_{g} \beta+\boldsymbol{e}_{g}\)。使用这种表示法,中心 2SLS 估计器可以写为

\[ \begin{aligned} \widehat{\beta}_{2 \text { sls }}-\beta &=\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{e} \\ &=\left(\boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1} \boldsymbol{Z}^{\prime} \boldsymbol{X}\right)^{-1} \boldsymbol{X}^{\prime} \boldsymbol{Z}\left(\boldsymbol{Z}^{\prime} \boldsymbol{Z}\right)^{-1}\left(\sum_{g=1}^{G} \boldsymbol{Z}_{g}^{\prime} \boldsymbol{e}_{g}\right) \end{aligned} \]

\(\widehat{\beta}_{2 s l s}\) 的集群鲁棒协方差矩阵估计器采用以下形式